Собственный голосовой стек Microsoft: что MAI-Voice-1 + MAI-Transcribe-1 значат для BibiGPT

Собственный голосовой стек Microsoft: что MAI-Voice-1 + MAI-Transcribe-1 значат для BibiGPT

Содержание

- Что такое MAI-Transcribe-1 и почему это важно для AI-транскрипции подкастов?

- MAI-Voice-1: 60 секунд аудио за 1 секунду

- MAI-Transcribe-1 vs Whisper / Voxtral: три ключевых отличия

- Что это значит для пользователей BibiGPT: более прочная база для пересказа подкастов

- Как BibiGPT планирует сосуществовать с серией MAI

- FAQ

- Итоги

Что такое MAI-Transcribe-1 и почему это важно для AI-транскрипции подкастов?

Краткий ответ: MAI-Transcribe-1 — собственная ASR-модель (автоматическое распознавание речи) Microsoft, представленная в апреле 2026 вместе с MAI-Voice-1. Её немедленный эффект на AI-транскрипцию подкастов — снижение коэффициента ошибок (WER) в многоязычных и шумных сценариях при меньшей стоимости инференса. Поэтому downstream-инструменты вроде AI-суммаризаторов подкастов могут опираться на более точные транскрипции за меньшие деньги.

2 апреля 2026 года команда Microsoft AI (MAI) выпустила сразу две собственные голосовые модели:

- MAI-Voice-1 — синтез речи (TTS). 60 секунд аудио за 1 секунду на одной GPU.

- MAI-Transcribe-1 — автоматическое распознавание речи (ASR). Новый SOTA на многоязычных бенчмарках с заметно меньшей задержкой.

Это первый раз, когда Microsoft заменила оба конца своего голосового стека на собственные модели вместо OpenAI Whisper или сторонних TTS. Сигнал ясен: базовые голосовые модели вступают в эпоху “первичные + сквозная низкая задержка”, и длинные аудио (подкасты, интервью, встречи) выиграют больше всех.

MAI-Voice-1: 60 секунд аудио за 1 секунду

Краткий ответ: MAI-Voice-1 — собственная TTS-модель Microsoft. Microsoft заявляет 60 секунд аудио за 1 секунду на одной GPU — одна из самых быстрых TTS-моделей в продакшене. Уже работает внутри Copilot Daily / Podcasts с очевидными импликациями для real-time ассистентов, низколатентного дубляжа и длинных текстовых нарративов.

Ключевое:

- 60× реального времени: 60 секунд текста → 1 секунда аудио, идеально для длинных нарративов

- Работает на одной GPU, в отличие от многих TTS-систем, требующих кластер

- Уже в продакшене внутри workflow Copilot Daily News и Podcasts

Импликация для сценариев “длинное аудио-видео резюме → подкаст” вроде BibiGPT: и входная сторона (транскрипция подкаста), и выходная (генерация “двухголосого подкаста”) теперь могут работать с гораздо меньшей задержкой. Генерация подкастов BibiGPT уже превращает любое видео в двухголосую беседу; по мере зрелости быстрого TTS вроде MAI-Voice-1 “суммаризация с одновременной озвучкой” становится возможной в реальном времени.

MAI-Transcribe-1 vs Whisper / Voxtral: три ключевых отличия

Краткий ответ: По сравнению с OpenAI Whisper-v3 и Mistral Voxtral, MAI-Transcribe-1 выделяется по трём осям: меньший WER (особенно в шумной среде и на доменных терминах), быстрый инференс и тесная интеграция с Azure / Copilot. Краткосрочно Whisper остаётся открытым стандартом по умолчанию; MAI-Transcribe-1 становится новым бенчмарком коммерческого API.

| Измерение | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Открытый код | Нет (коммерческий API) | Да (MIT) | Да (Apache 2.0) |

| Многоязычность | 25+ языков, стабильно CJK | 99 языков, слабее на длинном хвосте | EN + EU-центричный |

| Длинное аудио | Нативный контекст 60+ мин | Требует чанкинга | Длинный контекст поддерживается |

| Задержка | Значительно ниже Whisper | Средняя | Быстро |

| Развёртывание | На Azure | Self-host или cloud | Self-host open source |

| Цена | За минуту | Open source (платите за GPU) | Open source |

По данным блога Microsoft AI, серия MAI должна консолидировать голосовой стек по всему full-stack ИИ Microsoft (Search, Copilot, Office, Gaming, Bing) на собственных технологиях. Для downstream-приложений это означает более стабильные SLA и чёткое версионирование моделей.

Для продукта вроде BibiGPT, который не привязан к одной голосовой модели, MAI-Transcribe-1 — ещё одна опция в пуле пользовательского движка транскрипции, а не замена.

Что это значит для пользователей BibiGPT: более прочная база для пересказа подкастов

Краткий ответ: Три конкретные победы для пользователей BibiGPT — более точная транскрипция подкастов и длинных аудио, более плавный workflow перевода субтитров на нескольких языках и более богатый пул пользовательских движков транскрипции на выбор.

Кейс 1: длинные подкасты / интервью

Длинное аудио (>30 мин) — слабое место Whisper: чанкинг теряет контекст. Нативная поддержка длинного контекста MAI-Transcribe-1 означает, что подкасты Spotify и индустриальные интервью транскрибируются чище. См. гайд по workflow AI-резюме подкастов для сравнений.

Кейс 2: трансграничный многоязычный контент

Новости из разных регионов, JP / KR интервью, EN-CN двуязычные встречи — многоязычный WER MAI стабильнее в смешанных сценариях. Для создателей, выходящих в глобал, и трансграничных исследователей цепочка автоперевода при загрузке (распознавание → перевод) получает более точную ASR-базу.

Кейс 3: контент с плотной терминологией

Медицина, юриспруденция, финансы, техника — плотная терминология долго опиралась на специализированные движки вроде ElevenLabs Scribe. Добавление MAI-Transcribe-1 расширяет пул, чтобы пользователи могли выбрать оптимальный для их контента баланс цена / точность / язык.

Как BibiGPT планирует сосуществовать с серией MAI

Краткий ответ: Позиционирование BibiGPT никогда не предполагало ставку на одну голосовую модель. MAI-Voice-1 / Transcribe-1 делают ядро BibiGPT (транскрипция → суммаризация → интеллект-карта → статья / подкаст) основанным на более прочной базе.

Путь совместимости: подключить MAI-Transcribe-1 в пользовательский движок транскрипции

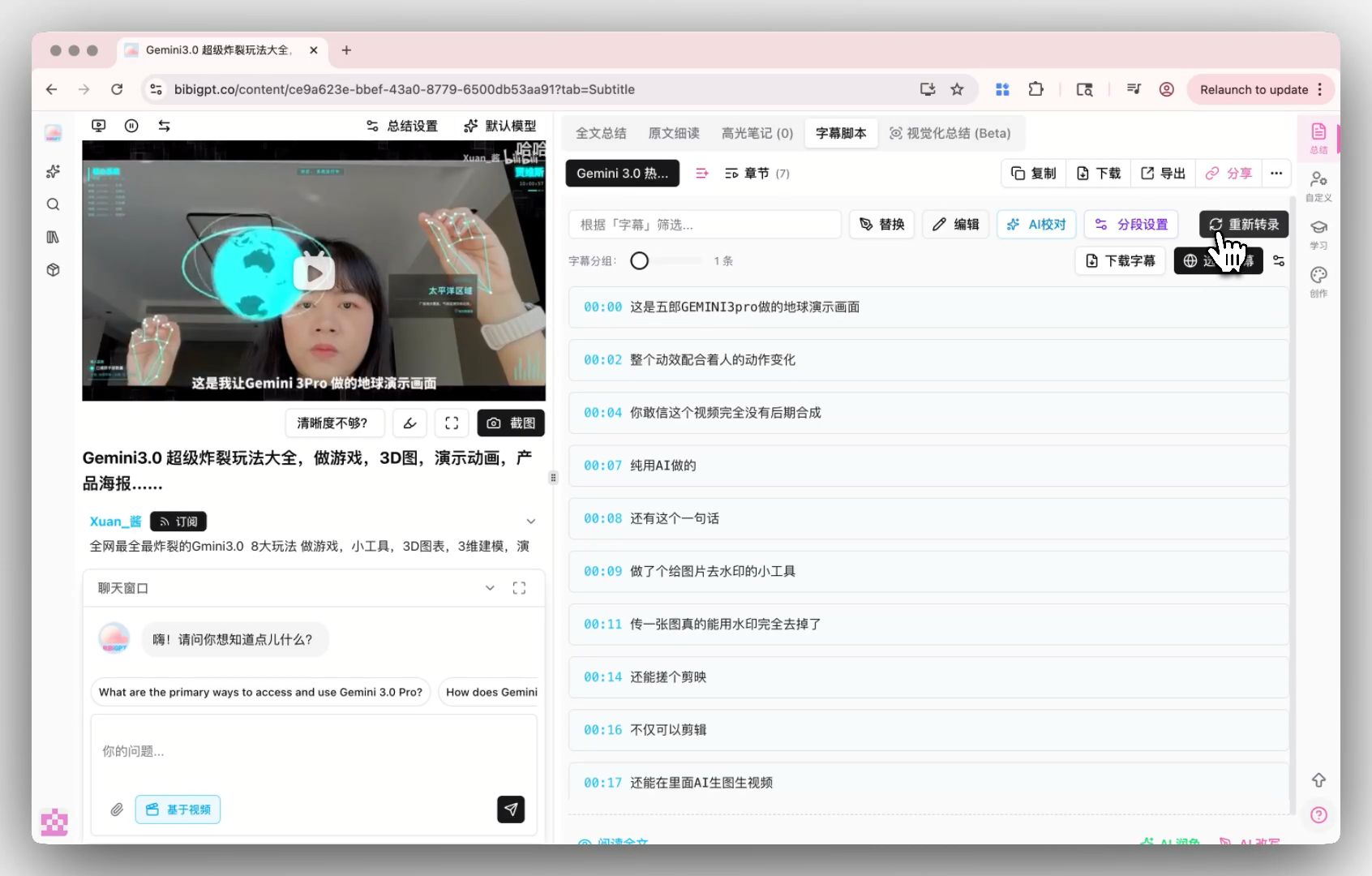

Пользовательский движок транскрипции BibiGPT сегодня поддерживает OpenAI Whisper и индустриального лидера ElevenLabs Scribe. MAI-Transcribe-1 пока доступен только через Azure / Copilot; как только публичные API созреют, BibiGPT оценит добавление в пул, чтобы пользователи могли переключать движки прямо из редактора субтитров.

Путь дополнения: MAI как база, BibiGPT как слой знаний-артефактов

Даже с лучшим ASR сырой выход — это всё ещё просто текст. Уникальная ценность BibiGPT находится ниже по потоку от транскрипта:

- Структурированные резюме + интеллект-карты — главное по главам для длинного аудио

- AI-заметки с хайлайтами — таймкоды хайлайтов одним кликом

- Резюме коллекций — синтез из множества эпизодов в карту знаний

- Генерация двухголосого подкаста — резюме обратно в аудио, замыкая цикл “подкаст → подкаст”

Эта архитектура “меняй базу, оставляй продуктовый слой” — то, что позволяет BibiGPT впитывать лучшие голосовые модели по мере их появления. Для углублённого чтения: Microsoft Copilot vs BibiGPT video summary и более ранний разбор MAI-Transcribe-1 vs Cohere open-source ASR.

FAQ

Q1: Открыт ли MAI-Transcribe-1? Можно ли self-host?

A: Нет. MAI-Transcribe-1 сейчас — коммерческое предложение через Azure / Copilot. Для self-hosting используйте OpenAI Whisper (MIT) или Mistral Voxtral (Apache 2.0).

Q2: Использует ли BibiGPT MAI-Transcribe-1 по умолчанию?

A: Пока нет. BibiGPT сегодня использует гибридный пайплайн собственной разработки + Whisper; пользователи могут переключиться на ElevenLabs Scribe в пользовательском движке транскрипции. MAI-Transcribe-1 будет оценён, как только публичные API созреют.

Q3: Что MAI-Voice-1 значит для создателей подкастов?

A: Создатели в итоге смогут использовать быстрый TTS вроде MAI-Voice-1 для разворота транскрипта в многоголосое аудио. Генерация подкастов BibiGPT уже превращает видео в двухголосую беседу; более быстрый TTS снизит задержку ещё сильнее.

Q4: Насколько MAI-Transcribe-1 лучше Whisper на китайских подкастах?

A: Публичные бенчмарки для китайского ограничены. Используйте BibiGPT, чтобы сравнить Whisper и ElevenLabs Scribe бок о бок уже сегодня; как только MAI-Transcribe-1 откроется, BibiGPT опубликует практическое сравнение.

Q5: Почему не поставить всем по умолчанию самую сильную модель?

A: Разные модели балансируют стоимость, точность и языковое покрытие. Жёсткая привязка к одной модели лишит пользователей контроля в граничных случаях (редкие языки, доменные термины). Пользовательский движок транскрипции возвращает этот выбор в руки пользователя.

Итоги

MAI-Voice-1 + MAI-Transcribe-1 от Microsoft знаменуют новую фазу для базовых голосовых моделей: первичные и сквозная низкая задержка. Для AI аудио-видео инструментов это апгрейд всего стека — более точная транскрипция, более быстрый синтез, более прочное длинное аудио.

Продуктовая философия BibiGPT никогда не сводилась к привязке к одной голосовой модели — она в том, чтобы превратить любую сильную базу в пользовательские артефакты знаний. Когда MAI созреет, BibiGPT добавит его в пул пользовательского движка транскрипции и продолжит выдавать самые надёжные AI-резюме для подкастов, трансграничных видео и длинного обучения.

Начните путь эффективного обучения с ИИ прямо сейчас:

- 🌐 Официальный сайт: https://aitodo.co

- 📱 Скачать мобильное: https://aitodo.co/app

- 💻 Скачать десктоп: https://aitodo.co/download/desktop

- ✨ Узнать больше функций: https://aitodo.co/features

BibiGPT Team