Microsoft का खुद का Voice Stack: MAI-Voice-1 + MAI-Transcribe-1 का BibiGPT Podcast Summaries के लिए क्या मतलब है

Microsoft का खुद का Voice Stack: MAI-Voice-1 + MAI-Transcribe-1 का BibiGPT Podcast Summaries के लिए क्या मतलब है

विषय-सूची

- MAI-Transcribe-1 क्या है और AI Podcast Transcription के लिए क्यों मायने रखता है?

- MAI-Voice-1: 1 सेकंड में 60 सेकंड ऑडियो

- MAI-Transcribe-1 vs Whisper / Voxtral: तीन Key Differences

- BibiGPT Users के लिए इसका क्या मतलब है: एक Sturdier Podcast-Summary Base

- BibiGPT MAI Series के साथ Coexist कैसे करने की योजना बना रहा है

- FAQ

- Wrap-up

MAI-Transcribe-1 क्या है और AI Podcast Transcription के लिए क्यों मायने रखता है?

त्वरित उत्तर: MAI-Transcribe-1 Microsoft का first-party ASR (automatic speech recognition) model है, जिसे अप्रैल 2026 में MAI-Voice-1 के साथ घोषित किया गया। AI podcast transcription पर इसका तत्काल प्रभाव मल्टीलिंगुअल और noisy परिदृश्यों में lower word error rate (WER) है, lower inference cost के साथ — इसलिए downstream tools जैसे AI podcast summarizers कम पैसे में अधिक सटीक transcripts पर build कर सकते हैं।

2 अप्रैल, 2026 को, Microsoft की MAI (Microsoft AI) team ने एक साथ दो first-party voice models शिप किए:

- MAI-Voice-1 — text-to-speech (TTS)। एक single GPU पर 1 सेकंड में 60 सेकंड ऑडियो।

- MAI-Transcribe-1 — automatic speech recognition (ASR)। मल्टीलिंगुअल benchmarks पर new SOTA काफी lower latency के साथ।

यह पहली बार है जब Microsoft ने OpenAI Whisper या third-party TTS पर निर्भर रहने के बजाय अपने voice stack के दोनों ends को in-house models के लिए swap किया है। सिग्नल स्पष्ट है: Foundation voice models एक “first-party + low-latency end-to-end” युग में प्रवेश कर रहे हैं, और long-form audio (podcasts, interviews, meetings) सबसे अधिक लाभ उठाएँगे।

MAI-Voice-1: 1 सेकंड में 60 सेकंड ऑडियो

त्वरित उत्तर: MAI-Voice-1 Microsoft का first-party TTS model है। Microsoft दावा करता है कि एक single GPU पर 1 सेकंड में 60 सेकंड ऑडियो — production में सबसे तेज़ TTS models में से एक। यह पहले से ही Copilot Daily / Podcasts के अंदर live है, real-time assistants, low-latency dubbing और long-form text narration के लिए स्पष्ट implications के साथ।

Highlights:

- 60× real-time: 60 सेकंड text → 1 सेकंड audio output, long-form narration के लिए आदर्श

- एक single GPU पर चलता है, कई TTS systems के विपरीत जिन्हें cluster की ज़रूरत होती है

- पहले से ही production में Copilot Daily News और Podcasts workflows के अंदर

BibiGPT जैसे “long audio-वीडियो सारांश → podcast” परिदृश्यों के लिए implication: input side (podcast transcription) और output side (एक “दो-होस्ट podcast” audio जनरेट करना) दोनों अब बहुत lower latency के साथ चल सकते हैं। BibiGPT का podcast जनरेशन पहले से ही किसी भी वीडियो को दो-होस्ट conversation में बदलता है; जैसे-जैसे MAI-Voice-1 जैसे fast TTS परिपक्व होते हैं, “narrating करते हुए summarize करना” real time में feasible हो जाता है।

MAI-Transcribe-1 vs Whisper / Voxtral: तीन Key Differences

त्वरित उत्तर: OpenAI Whisper-v3 और Mistral Voxtral की तुलना में, MAI-Transcribe-1 तीन axes पर अलग खड़ा है: lower WER (विशेष रूप से noisy environments और domain terms पर), faster inference, और tight Azure / Copilot integration। Short-term, Whisper अभी भी open-source default है; MAI-Transcribe-1 नया commercial API benchmark बनता है।

| Dimension | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open source | नहीं (commercial API) | हाँ (MIT) | हाँ (Apache 2.0) |

| Multilingual | 25+ भाषाएँ, stable CJK | 99 भाषाएँ, long-tail पर weaker | EN + EU-केंद्रित |

| Long audio | Native 60+ min context | Chunking ज़रूरी | Long context सपोर्टेड |

| Latency | Whisper से काफी lower | Medium | Fast |

| Deployment | Azure-hosted | Self-host या cloud | Self-host open source |

| Pricing | Per-minute | Open source (GPU के लिए pay) | Open source |

Microsoft AI के blog के अनुसार, MAI series Microsoft के full-stack AI (Search, Copilot, Office, Gaming, Bing) में voice stack को first-party tech पर consolidate करने के लिए है। Downstream apps के लिए, यह अधिक stable SLAs और स्पष्ट model versioning में translate होता है।

BibiGPT जैसे product के लिए — जो किसी एक voice model से शादी नहीं करता — MAI-Transcribe-1 custom transcription engine pool में एक और option है, replacement नहीं।

BibiGPT Users के लिए इसका क्या मतलब है: एक Sturdier Podcast-Summary Base

त्वरित उत्तर: BibiGPT users के लिए तीन concrete wins — podcasts और long audio के लिए अधिक सटीक transcription, smoother मल्टीलिंगुअल सबटाइटल अनुवाद workflow, और चुनने के लिए custom transcription engines का अधिक richer pool।

Case 1: Long-form podcast / interview audio

Long audio (>30 min) Whisper का weak spot है — chunking context खोता है। MAI-Transcribe-1 का native long-context सपोर्ट का मतलब है Spotify podcasts और इंडस्ट्री interviews अधिक cleanly transcribe होते हैं। तुलना के लिए AI podcast सारांश workflow guide देखें।

Case 2: Cross-border मल्टीलिंगुअल कंटेंट

Regions में news, JP / KR interviews, EN-CN bilingual meetings — MAI का मल्टीलिंगुअल WER mixed परिदृश्यों में अधिक stable है। Global जाने वाले creators या cross-border researchers के लिए, auto-translate on upload chain (recognize → translate) एक अधिक सटीक ASR base पाता है।

Case 3: Term-dense domain कंटेंट

Medical, legal, financial, technical — dense terminology लंबे समय से ElevenLabs Scribe जैसे specialist engines पर निर्भर रही है। MAI-Transcribe-1 जोड़ना pool को broaden करता है, इसलिए users जो भी price / accuracy / language balance उनके कंटेंट के लिए सबसे अच्छा फ़िट हो वह pick कर सकते हैं।

BibiGPT MAI Series के साथ Coexist कैसे करने की योजना बना रहा है

त्वरित उत्तर: BibiGPT की positioning कभी एक single voice model पर bet लगाने की नहीं रही है। MAI-Voice-1 / Transcribe-1 BibiGPT के core flow (transcribe → summarize → mind map → article / podcast) को एक sturdier base पर चलाते हैं।

Compatibility path: MAI-Transcribe-1 को custom transcription engine में plug करें

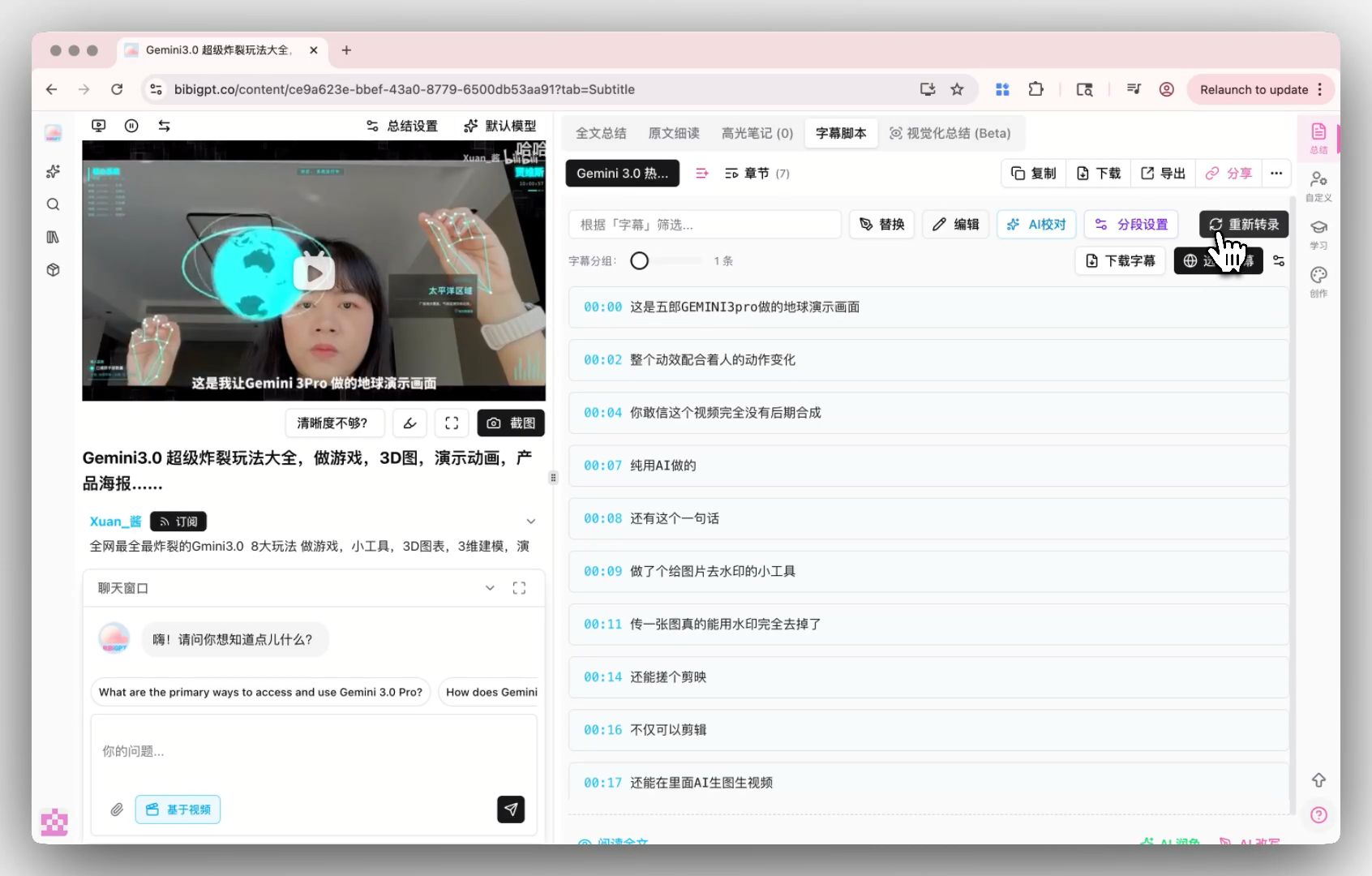

BibiGPT का custom transcription engine आज OpenAI Whisper और इंडस्ट्री-leading ElevenLabs Scribe सपोर्ट करता है। MAI-Transcribe-1 वर्तमान में Azure / Copilot-only है; जब public APIs परिपक्व होंगे, BibiGPT इसे pool में जोड़ने का evaluate करेगा ताकि users सीधे subtitle editor से engines switch कर सकें।

Complement path: MAI as base, BibiGPT as knowledge-artifact layer

सबसे अच्छे ASR के साथ भी, raw output अभी भी सिर्फ़ text है। BibiGPT का unique मूल्य transcript के downstream बैठता है:

- स्ट्रक्चर्ड सारांश + माइंड मैप — long audio का chapter-level breakdown

- AI highlight notes — एक क्लिक के साथ time-stamped highlights

- Collection summary — multi-episode synthesis एक नॉलेज map में

- दो-होस्ट podcast जनरेशन — सारांश को वापस audio में बदला जाता है, “podcast → podcast” loop को बंद करते हुए

यह “swap-the-base, keep-the-product-layer” architecture वही है जो BibiGPT को सबसे अच्छे voice models को absorb करने देता है जैसे वे आते हैं। गहन पठन: Microsoft Copilot vs BibiGPT वीडियो सारांश और MAI-Transcribe-1 vs Cohere open-source ASR पर पहले की take।

FAQ

Q1: क्या MAI-Transcribe-1 open source है? क्या मैं self-host कर सकता हूँ?

A: नहीं। MAI-Transcribe-1 वर्तमान में Azure / Copilot के माध्यम से एक commercial offering है। Self-hosting के लिए, OpenAI Whisper (MIT) या Mistral Voxtral (Apache 2.0) के साथ रहें।

Q2: क्या BibiGPT default रूप से MAI-Transcribe-1 का उपयोग करता है?

A: अभी नहीं। BibiGPT आज एक in-house + Whisper hybrid pipeline का उपयोग करता है; users custom transcription engine में ElevenLabs Scribe में switch कर सकते हैं। MAI-Transcribe-1 का evaluate तब किया जाएगा जब public APIs परिपक्व होंगे।

Q3: Podcast creators के लिए MAI-Voice-1 का क्या मतलब है?

A: Creators अंततः MAI-Voice-1 जैसे fast TTS का उपयोग करके transcript को multi-host audio में reverse कर सकेंगे। BibiGPT का podcast जनरेशन पहले से ही एक वीडियो को दो-होस्ट conversation में बदलता है; faster TTS latency को और drop करेगा।

Q4: चीनी podcasts पर MAI-Transcribe-1 Whisper से कितना बेहतर है?

A: चीनी के लिए public benchmarks सीमित हैं। आज Whisper vs ElevenLabs Scribe साइड-बाय-साइड चलाने के लिए BibiGPT का उपयोग करें; एक बार MAI-Transcribe-1 खुलने पर, BibiGPT एक hands-on तुलना publish करेगा।

Q5: सबको default रूप से सबसे मज़बूत model क्यों नहीं?

A: विभिन्न models cost, accuracy और language coverage के बीच trade off करते हैं। एक single model को hard-binding करना edge cases (rare languages, domain terms) में users से control छीनेगा। Custom transcription engine उस choice को user के हाथों में वापस रखता है।

Wrap-up

Microsoft का MAI-Voice-1 + MAI-Transcribe-1 foundation voice models के लिए एक नया phase mark करते हैं: first-party और end-to-end low latency। AI audio-वीडियो tools के लिए, यह एक whole-stack upgrade है — अधिक सटीक transcription, faster synthesis, sturdier long audio।

BibiGPT का product philosophy कभी एक voice model में lock in करने का नहीं रहा है — यह किसी भी मज़बूत base को user-facing knowledge artifacts में बदलने का है। जब MAI परिपक्व होगा, BibiGPT इसे custom transcription engine pool में जोड़ेगा और podcasts, cross-border videos और long-form learning के लिए सबसे विश्वसनीय AI summaries delivering रखेगा।

अभी अपनी AI कुशल सीखने की यात्रा शुरू करें:

- 🌐 आधिकारिक वेबसाइट: https://aitodo.co

- 📱 मोबाइल डाउनलोड: https://aitodo.co/app

- 💻 डेस्कटॉप डाउनलोड: https://aitodo.co/download/desktop

- ✨ और फ़ीचर्स जानें: https://aitodo.co/features

BibiGPT Team