El stack de voz propio de Microsoft: qué significan MAI-Voice-1 + MAI-Transcribe-1 para los resúmenes de podcast de BibiGPT

El stack de voz propio de Microsoft: qué significan MAI-Voice-1 + MAI-Transcribe-1 para los resúmenes de podcast de BibiGPT

Contenidos

- ¿Qué es MAI-Transcribe-1 y por qué importa para la transcripción IA de podcast?

- MAI-Voice-1: 60 segundos de audio en 1 segundo

- MAI-Transcribe-1 vs Whisper / Voxtral: tres diferencias clave

- Lo que significa para los usuarios de BibiGPT: una base más sólida para resúmenes de podcast

- Cómo BibiGPT planea coexistir con la serie MAI

- FAQ

- Cierre

¿Qué es MAI-Transcribe-1 y por qué importa para la transcripción IA de podcast?

Respuesta rápida: MAI-Transcribe-1 es el modelo ASR (reconocimiento automático de habla) first-party de Microsoft, anunciado en abril 2026 junto a MAI-Voice-1. Su efecto inmediato en la transcripción IA de podcast es una menor tasa de error de palabras (WER) en escenarios multilingües y ruidosos, con menor costo de inferencia — para que herramientas downstream como resumidores IA de podcast puedan construir sobre transcripciones más precisas por menos dinero.

El 2 de abril 2026, el equipo MAI (Microsoft AI) de Microsoft envió dos modelos de voz first-party a la vez:

- MAI-Voice-1 — text-to-speech (TTS). 60 segundos de audio en 1 segundo en una sola GPU.

- MAI-Transcribe-1 — reconocimiento automático de habla (ASR). Nuevo SOTA en benchmarks multilingües con latencia notablemente menor.

Es la primera vez que Microsoft cambia ambos extremos de su stack de voz por modelos in-house en lugar de depender de OpenAI Whisper o TTS de terceros. La señal es clara: los modelos foundation de voz están entrando a una era “first-party + low-latency end-to-end”, y el audio largo (podcasts, entrevistas, reuniones) será el que más se beneficie.

MAI-Voice-1: 60 segundos de audio en 1 segundo

Respuesta rápida: MAI-Voice-1 es el modelo TTS first-party de Microsoft. Microsoft afirma 60 segundos de audio en 1 segundo en una sola GPU — entre los modelos TTS más rápidos en producción. Ya está vivo dentro de Copilot Daily / Podcasts, con implicaciones claras para asistentes en tiempo real, doblaje de baja latencia y narración de texto largo.

Highlights:

- 60× tiempo real: 60 segundos de texto → 1 segundo de output de audio, ideal para narración larga

- Corre en una sola GPU, a diferencia de muchos sistemas TTS que necesitan un cluster

- Ya en producción dentro de los workflows de Copilot Daily News y Podcasts

Implicación para escenarios “resumen de audio-video largo → podcast” como BibiGPT: tanto el lado de entrada (transcripción de podcast) como el lado de salida (generación de audio “podcast con dos presentadores”) ahora pueden correr con latencia mucho más baja. La generación de podcast de BibiGPT ya convierte cualquier video en una conversación con dos presentadores; conforme TTS rápido como MAI-Voice-1 madura, “resumir mientras narra” se vuelve viable en tiempo real.

MAI-Transcribe-1 vs Whisper / Voxtral: tres diferencias clave

Respuesta rápida: comparado con OpenAI Whisper-v3 y Mistral Voxtral, MAI-Transcribe-1 destaca en tres ejes: WER más bajo (especialmente en ambientes ruidosos y términos de dominio), inferencia más rápida e integración estrecha con Azure / Copilot. A corto plazo, Whisper sigue siendo el default open-source; MAI-Transcribe-1 se vuelve el nuevo benchmark de API comercial.

| Dimensión | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open source | No (API comercial) | Sí (MIT) | Sí (Apache 2.0) |

| Multilingüe | Más de 25 idiomas, CJK estable | 99 idiomas, más débil en long-tail | EN + EU-céntrico |

| Audio largo | Contexto nativo 60+ min | Necesita chunking | Soporta contexto largo |

| Latencia | Significativamente menor que Whisper | Media | Rápida |

| Despliegue | Hospedado en Azure | Self-host o cloud | Self-host open source |

| Precios | Por minuto | Open source (paga por GPU) | Open source |

Según el blog de Microsoft AI, la serie MAI tiene como meta consolidar el stack de voz a través de la IA full-stack de Microsoft (Search, Copilot, Office, Gaming, Bing) sobre tech first-party. Para apps downstream, eso se traduce en SLAs más estables y versionado de modelo más claro.

Para un producto como BibiGPT — que no se casa con un solo modelo de voz — MAI-Transcribe-1 es una opción más en el pool del motor de transcripción personalizado, no un reemplazo.

Lo que significa para los usuarios de BibiGPT: una base más sólida para resúmenes de podcast

Respuesta rápida: tres ganancias concretas para los usuarios de BibiGPT — transcripción más precisa para podcasts y audio largo, workflow de traducción de subtítulos multilingüe más fluido, y un pool más rico de motores de transcripción personalizados para elegir.

Caso 1: audio de podcast / entrevista de formato largo

El audio largo (>30 min) es el punto débil de Whisper — el chunking pierde contexto. El soporte de contexto largo nativo de MAI-Transcribe-1 significa que los podcasts Spotify y entrevistas de industria se transcriben más limpio. Ve la guía de workflow de resumen de podcast IA para comparativas.

Caso 2: contenido cross-border multilingüe

Noticias entre regiones, entrevistas JP / KR, reuniones bilingües EN-CN — el WER multilingüe de MAI es más estable en escenarios mixtos. Para creadores que se globalizan o investigadores cross-border, la cadena de auto-traducción al subir (reconocer → traducir) obtiene una base ASR más precisa.

Caso 3: contenido de dominio denso en términos

Médico, legal, financiero, técnico — la terminología densa por mucho tiempo se ha apoyado en motores especialistas como ElevenLabs Scribe. Añadir MAI-Transcribe-1 amplía el pool, para que los usuarios puedan elegir el balance precio / precisión / idioma que mejor calce con su contenido.

Cómo BibiGPT planea coexistir con la serie MAI

Respuesta rápida: el posicionamiento de BibiGPT nunca ha sido apostar a un solo modelo de voz. MAI-Voice-1 / Transcribe-1 hacen que el flujo core de BibiGPT (transcribir → resumir → mapa mental → artículo / podcast) corra sobre una base más sólida.

Camino de compatibilidad: enchufar MAI-Transcribe-1 en el motor de transcripción personalizado

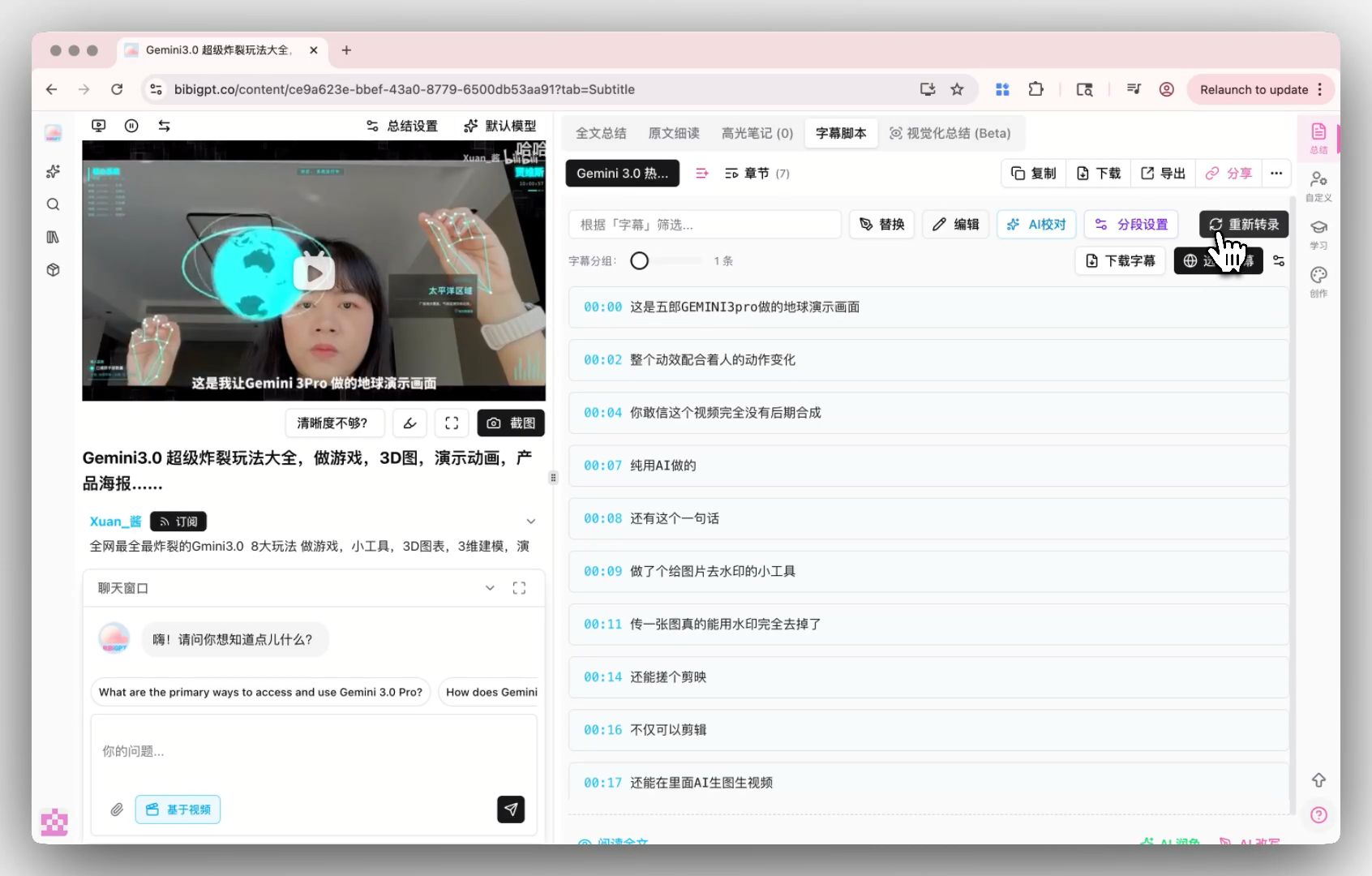

El motor de transcripción personalizado de BibiGPT hoy soporta OpenAI Whisper y el líder de industria ElevenLabs Scribe. MAI-Transcribe-1 es actualmente solo Azure / Copilot; una vez que las APIs públicas maduren, BibiGPT evaluará añadirlo al pool para que los usuarios puedan cambiar motores justo desde el editor de subtítulos.

Camino de complemento: MAI como base, BibiGPT como capa de artefacto de conocimiento

Incluso con el mejor ASR, el output crudo sigue siendo solo texto. El valor único de BibiGPT está downstream de la transcripción:

- Resúmenes estructurados + mapas mentales — desglose a nivel de capítulo de audio largo

- Notas de highlights IA — highlights con timestamp con un clic

- Resumen de colección — síntesis multi-episodio en un mapa de conocimiento

- Generación de podcast con dos presentadores — resumen convertido de regreso a audio, cerrando el loop “podcast → podcast”

Esta arquitectura “swap-the-base, keep-the-product-layer” es lo que le permite a BibiGPT absorber los mejores modelos de voz conforme aparecen. Lectura más profunda: Microsoft Copilot vs resumen de video BibiGPT y la toma anterior sobre MAI-Transcribe-1 vs ASR open-source de Cohere.

FAQ

Q1: ¿MAI-Transcribe-1 es open source? ¿Puedo self-hostearlo?

R: No. MAI-Transcribe-1 es actualmente una oferta comercial a través de Azure / Copilot. Para self-hosting, quédate con OpenAI Whisper (MIT) o Mistral Voxtral (Apache 2.0).

Q2: ¿BibiGPT usa MAI-Transcribe-1 por defecto?

R: Aún no. BibiGPT hoy usa un pipeline híbrido in-house + Whisper; los usuarios pueden cambiar a ElevenLabs Scribe en el motor de transcripción personalizado. MAI-Transcribe-1 será evaluado una vez que las APIs públicas maduren.

Q3: ¿Qué significa MAI-Voice-1 para los creadores de podcast?

R: Eventualmente los creadores podrán usar TTS rápido como MAI-Voice-1 para revertir una transcripción a audio multi-presentador. La generación de podcast de BibiGPT ya convierte un video en una conversación con dos presentadores; TTS más rápido bajará la latencia más.

Q4: ¿Qué tanto mejor es MAI-Transcribe-1 que Whisper en podcasts en chino?

R: Los benchmarks públicos para chino son limitados. Usa BibiGPT para correr Whisper vs ElevenLabs Scribe lado a lado hoy; una vez que MAI-Transcribe-1 abra, BibiGPT publicará una comparativa práctica.

Q5: ¿Por qué no defaultear a todos al modelo más fuerte?

R: Distintos modelos negocian costo, precisión y cobertura de idioma. Hard-bindear un solo modelo le quitaría a los usuarios el control en edge cases (idiomas raros, términos de dominio). El motor de transcripción personalizado pone esa elección de regreso en manos del usuario.

Cierre

MAI-Voice-1 + MAI-Transcribe-1 de Microsoft marcan una nueva fase para los modelos foundation de voz: first-party y end-to-end de baja latencia. Para herramientas IA de audio-video, eso es una mejora whole-stack — transcripción más precisa, síntesis más rápida, audio largo más sólido.

La filosofía de producto de BibiGPT nunca ha sido lockear un solo modelo de voz — es convertir cualquier base fuerte en artefactos de conocimiento user-facing. Cuando MAI madure, BibiGPT lo añadirá al pool del motor de transcripción personalizado y seguirá entregando los resúmenes IA más confiables para podcasts, videos cross-border y aprendizaje de formato largo.

Empieza tu viaje de aprendizaje IA eficiente ahora:

- 🌐 Sitio oficial: https://aitodo.co

- 📱 Descarga móvil: https://aitodo.co/app

- 💻 Descarga escritorio: https://aitodo.co/download/desktop

- ✨ Más funciones: https://aitodo.co/features

BibiGPT Team