Stack Suara Sendiri Microsoft: Apa Arti MAI-Voice-1 + MAI-Transcribe-1 untuk Ringkasan Podcast BibiGPT

Stack Suara Sendiri Microsoft: Apa Arti MAI-Voice-1 + MAI-Transcribe-1 untuk Ringkasan Podcast BibiGPT

Daftar Isi

- Apa Itu MAI-Transcribe-1 dan Mengapa Penting untuk Transkripsi Podcast AI?

- MAI-Voice-1: Audio 60 Detik dalam 1 Detik

- MAI-Transcribe-1 vs Whisper / Voxtral: Tiga Perbedaan Kunci

- Arti untuk Pengguna BibiGPT: Basis Ringkasan Podcast yang Lebih Kokoh

- Bagaimana BibiGPT Berencana Coexist dengan Seri MAI

- FAQ

- Kesimpulan

Apa Itu MAI-Transcribe-1 dan Mengapa Penting untuk Transkripsi Podcast AI?

Jawaban cepat: MAI-Transcribe-1 adalah model ASR (automatic speech recognition) first-party Microsoft, diumumkan di April 2026 bersama MAI-Voice-1. Efek langsungnya pada transkripsi podcast AI adalah word error rate (WER) yang lebih rendah dalam skenario multibahasa dan berisik, dengan biaya inference yang lebih rendah — sehingga tool downstream seperti AI podcast summarizer bisa membangun di atas transkrip yang lebih akurat dengan biaya lebih murah.

Pada 2 April 2026, tim MAI (Microsoft AI) mengirim dua model suara first-party sekaligus:

- MAI-Voice-1 — text-to-speech (TTS). Audio 60 detik dalam 1 detik di GPU tunggal.

- MAI-Transcribe-1 — automatic speech recognition (ASR). SOTA baru di benchmark multibahasa dengan latency yang jauh lebih rendah.

Ini adalah pertama kalinya Microsoft menukar kedua ujung stack suaranya untuk model in-house alih-alih mengandalkan OpenAI Whisper atau TTS pihak ketiga. Sinyalnya jelas: model suara fondasi memasuki era “first-party + low-latency end-to-end”, dan audio panjang (podcast, wawancara, meeting) akan paling diuntungkan.

MAI-Voice-1: Audio 60 Detik dalam 1 Detik

Jawaban cepat: MAI-Voice-1 adalah model TTS first-party Microsoft. Microsoft mengklaim audio 60 detik dalam 1 detik di GPU tunggal — di antara model TTS tercepat dalam produksi. Sudah live di dalam Copilot Daily / Podcasts, dengan implikasi jelas untuk asisten real-time, dubbing low-latency dan narasi teks panjang.

Highlight:

- 60× real-time: 60 detik teks → 1 detik output audio, ideal untuk narasi panjang

- Berjalan di GPU tunggal, tidak seperti banyak sistem TTS yang butuh cluster

- Sudah dalam produksi di dalam alur kerja Copilot Daily News dan Podcasts

Implikasi untuk skenario “ringkasan audio-video panjang → podcast” seperti BibiGPT: baik sisi input (transkripsi podcast) maupun sisi output (generate audio “podcast dua host”) sekarang bisa berjalan dengan latency jauh lebih rendah. Generasi podcast BibiGPT sudah mengubah video apa pun menjadi percakapan dua host; saat TTS cepat seperti MAI-Voice-1 matang, “ringkas sambil narasi” menjadi feasible secara real-time.

MAI-Transcribe-1 vs Whisper / Voxtral: Tiga Perbedaan Kunci

Jawaban cepat: Dibandingkan dengan OpenAI Whisper-v3 dan Mistral Voxtral, MAI-Transcribe-1 menonjol pada tiga axis: WER lebih rendah (terutama di lingkungan berisik dan pada istilah domain), inference lebih cepat, dan integrasi Azure / Copilot ketat. Jangka pendek, Whisper masih default open-source; MAI-Transcribe-1 menjadi benchmark API komersial baru.

| Dimensi | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open source | Tidak (API komersial) | Ya (MIT) | Ya (Apache 2.0) |

| Multibahasa | 25+ bahasa, CJK stabil | 99 bahasa, lebih lemah pada long-tail | EN + EU-sentris |

| Audio panjang | Native 60+ menit konteks | Butuh chunking | Konteks panjang didukung |

| Latency | Jauh lebih rendah dari Whisper | Sedang | Cepat |

| Deployment | Azure-hosted | Self-host atau cloud | Self-host open source |

| Pricing | Per-menit | Open source (bayar GPU) | Open source |

Per blog Microsoft AI, seri MAI dimaksudkan untuk mengonsolidasikan stack suara di seluruh AI full-stack Microsoft (Search, Copilot, Office, Gaming, Bing) di teknologi first-party. Untuk app downstream, itu diterjemahkan menjadi SLA yang lebih stabil dan versioning model yang lebih jelas.

Untuk produk seperti BibiGPT — yang tidak menikahi satu model suara pun — MAI-Transcribe-1 adalah satu opsi lagi di pool custom transcription engine, bukan pengganti.

Arti untuk Pengguna BibiGPT: Basis Ringkasan Podcast yang Lebih Kokoh

Jawaban cepat: Tiga keuntungan konkret untuk pengguna BibiGPT — transkripsi lebih akurat untuk podcast dan audio panjang, alur kerja terjemahan subtitle multibahasa lebih halus, dan pool custom transcription engine yang lebih kaya untuk dipilih.

Kasus 1: Audio podcast / wawancara format panjang

Audio panjang (>30 menit) adalah titik lemah Whisper — chunking kehilangan konteks. Dukungan konteks panjang native MAI-Transcribe-1 berarti podcast Spotify dan wawancara industri ditranskripsi lebih bersih. Lihat panduan alur kerja ringkasan podcast AI untuk perbandingan.

Kasus 2: Konten multibahasa lintas-batas

Berita di seluruh region, wawancara JP / KR, meeting bilingual EN-CN — WER multibahasa MAI lebih stabil di skenario campuran. Untuk kreator yang go global atau periset lintas-batas, rantai auto-translate on upload (recognize → translate) mendapat basis ASR yang lebih akurat.

Kasus 3: Konten domain padat-istilah

Medis, hukum, finansial, teknis — terminologi padat sudah lama bersandar pada engine spesialis seperti ElevenLabs Scribe. Menambahkan MAI-Transcribe-1 memperluas pool, sehingga pengguna bisa memilih balance harga / akurasi / bahasa apa pun yang paling cocok dengan konten mereka.

Bagaimana BibiGPT Berencana Coexist dengan Seri MAI

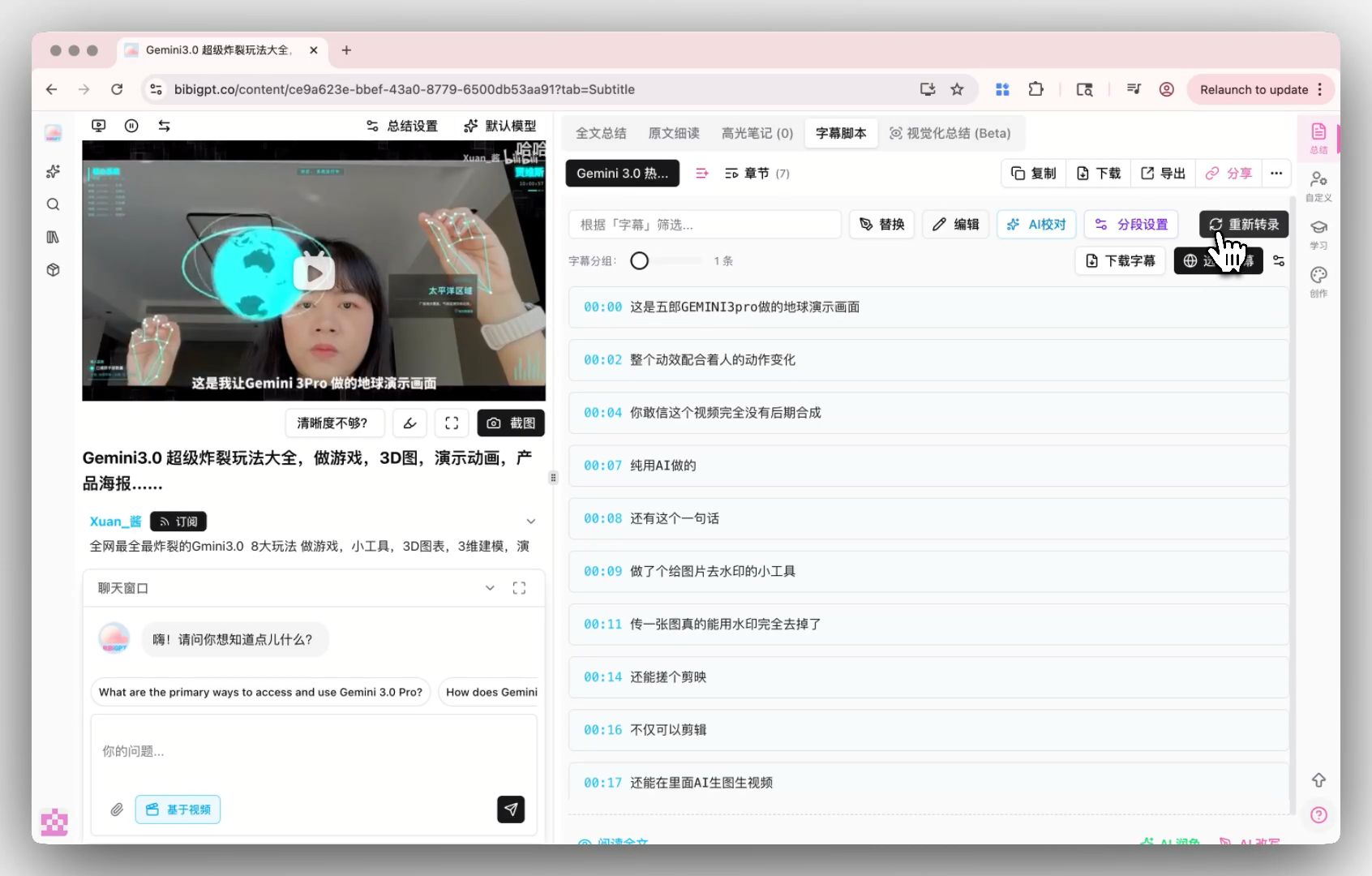

Jawaban cepat: Positioning BibiGPT tidak pernah bertaruh pada satu model suara. MAI-Voice-1 / Transcribe-1 membuat alur inti BibiGPT (transkripsi → ringkas → mind map → artikel / podcast) berjalan di basis yang lebih kokoh.

Jalur kompatibilitas: colok MAI-Transcribe-1 ke custom transcription engine

Custom transcription engine BibiGPT hari ini mendukung OpenAI Whisper dan ElevenLabs Scribe pemimpin industri. MAI-Transcribe-1 saat ini hanya Azure / Copilot; setelah API publik matang, BibiGPT akan mengevaluasi penambahannya ke pool sehingga pengguna bisa switch engine langsung dari editor subtitle.

Jalur pelengkap: MAI sebagai basis, BibiGPT sebagai lapisan artefak-pengetahuan

Bahkan dengan ASR terbaik, output mentah masih hanya teks. Nilai unik BibiGPT duduk downstream dari transkrip:

- Ringkasan terstruktur + mind map — breakdown level-chapter audio panjang

- Catatan highlight AI — highlight ber-timestamp dengan satu klik

- Ringkasan koleksi — sintesis multi-episode menjadi peta pengetahuan

- Generasi podcast dua host — ringkasan diubah kembali menjadi audio, menutup loop “podcast → podcast”

Arsitektur “tukar-basis, simpan-lapisan-produk” inilah yang memungkinkan BibiGPT menyerap model suara terbaik saat muncul. Bacaan lebih dalam: Microsoft Copilot vs ringkasan video BibiGPT dan take sebelumnya tentang MAI-Transcribe-1 vs Cohere ASR open-source.

FAQ

Q1: Apakah MAI-Transcribe-1 open source? Bisa saya self-host?

A: Tidak. MAI-Transcribe-1 saat ini adalah penawaran komersial melalui Azure / Copilot. Untuk self-hosting, tetap dengan OpenAI Whisper (MIT) atau Mistral Voxtral (Apache 2.0).

Q2: Apakah BibiGPT memakai MAI-Transcribe-1 secara default?

A: Belum. BibiGPT hari ini memakai pipeline hybrid in-house + Whisper; pengguna bisa switch ke ElevenLabs Scribe di custom transcription engine. MAI-Transcribe-1 akan dievaluasi setelah API publik matang.

Q3: Apa arti MAI-Voice-1 untuk kreator podcast?

A: Kreator pada akhirnya akan bisa memakai TTS cepat seperti MAI-Voice-1 untuk membalik transkrip menjadi audio multi-host. Generasi podcast BibiGPT sudah mengubah video menjadi percakapan dua host; TTS lebih cepat akan menurunkan latency lebih jauh.

Q4: Seberapa lebih baik MAI-Transcribe-1 dari Whisper pada podcast Mandarin?

A: Benchmark publik untuk Mandarin terbatas. Gunakan BibiGPT untuk menjalankan Whisper vs ElevenLabs Scribe berdampingan hari ini; setelah MAI-Transcribe-1 terbuka, BibiGPT akan mempublikasikan perbandingan hands-on.

Q5: Mengapa tidak default semua orang ke model terkuat?

A: Model berbeda mempertukarkan biaya, akurasi dan cakupan bahasa. Hard-binding satu model akan melepas kontrol pengguna di edge case (bahasa langka, istilah domain). Custom transcription engine mengembalikan pilihan itu ke tangan pengguna.

Kesimpulan

MAI-Voice-1 + MAI-Transcribe-1 dari Microsoft menandai fase baru untuk model suara fondasi: first-party dan end-to-end low latency. Untuk tool audio-video AI, itu upgrade whole-stack — transkripsi lebih akurat, sintesis lebih cepat, audio panjang lebih kokoh.

Filosofi produk BibiGPT tidak pernah mengunci satu model suara — itu untuk mengubah basis kuat apa pun menjadi artefak pengetahuan yang menghadap pengguna. Saat MAI matang, BibiGPT akan menambahkannya ke pool custom transcription engine dan terus memberikan ringkasan AI paling reliable untuk podcast, video lintas-batas dan pembelajaran format panjang.

Mulai perjalanan belajar efisien AI Anda sekarang:

- 🌐 Website Resmi: https://aitodo.co

- 📱 Download Mobile: https://aitodo.co/app

- 💻 Download Desktop: https://aitodo.co/download/desktop

- ✨ Pelajari Lebih Banyak Fitur: https://aitodo.co/features

BibiGPT Team