Stack de voz própria da Microsoft: o que MAI-Voice-1 + MAI-Transcribe-1 significam para resumos de podcast no BibiGPT

Stack de voz própria da Microsoft: o que MAI-Voice-1 + MAI-Transcribe-1 significam para resumos de podcast no BibiGPT

Sumário

- O que é o MAI-Transcribe-1 e por que importa para transcrição de podcast com IA?

- MAI-Voice-1: 60 segundos de áudio em 1 segundo

- MAI-Transcribe-1 vs Whisper / Voxtral: três diferenças-chave

- O que significa para usuários do BibiGPT: uma base mais sólida para resumo de podcast

- Como o BibiGPT planeja coexistir com a série MAI

- FAQ

- Encerramento

O que é o MAI-Transcribe-1 e por que importa para transcrição de podcast com IA?

Resposta rápida: O MAI-Transcribe-1 é o modelo ASR (reconhecimento automático de fala) first-party da Microsoft, anunciado em abril de 2026 ao lado do MAI-Voice-1. Seu efeito imediato sobre transcrição de podcast com IA é uma menor taxa de erro de palavra (WER) em cenários multilíngues e ruidosos, com custo de inferência menor — então ferramentas a jusante como resumidores de podcast com IA podem se basear em transcrições mais precisas por menos dinheiro.

Em 2 de abril de 2026, a equipe MAI (Microsoft AI) lançou de uma vez dois modelos de voz first-party:

- MAI-Voice-1 — text-to-speech (TTS). 60 segundos de áudio em 1 segundo em uma única GPU.

- MAI-Transcribe-1 — reconhecimento automático de fala (ASR). Novo SOTA em benchmarks multilíngues com latência notavelmente menor.

É a primeira vez que a Microsoft trocou as duas pontas do seu stack de voz por modelos in-house em vez de depender do OpenAI Whisper ou de TTS de terceiros. O sinal é claro: modelos de voz fundacionais estão entrando em uma era “first-party + baixa latência ponta a ponta”, e áudio longo (podcasts, entrevistas, reuniões) será o que mais se beneficia.

MAI-Voice-1: 60 segundos de áudio em 1 segundo

Resposta rápida: O MAI-Voice-1 é o modelo TTS first-party da Microsoft. A Microsoft afirma 60 segundos de áudio em 1 segundo em uma única GPU — entre os modelos TTS mais rápidos em produção. Já está vivo dentro do Copilot Daily / Podcasts, com implicações claras para assistentes em tempo real, dublagem de baixa latência e narração de texto longo.

Destaques:

- 60× tempo real: 60 segundos de texto → 1 segundo de áudio de saída, ideal para narração longa

- Roda em uma única GPU, diferente de muitos sistemas TTS que precisam de cluster

- Já em produção dentro dos fluxos Copilot Daily News e Podcasts

Implicação para cenários “resumo de áudio-vídeo longo → podcast” como o BibiGPT: tanto o lado de input (transcrição de podcast) quanto o de output (gerar áudio “podcast com dois apresentadores”) podem agora rodar com latência muito menor. A geração de podcast do BibiGPT já transforma qualquer vídeo em uma conversa com dois apresentadores; à medida que TTS rápido como MAI-Voice-1 amadurece, “resumir enquanto narra” vira viável em tempo real.

MAI-Transcribe-1 vs Whisper / Voxtral: três diferenças-chave

Resposta rápida: Comparado ao OpenAI Whisper-v3 e ao Mistral Voxtral, o MAI-Transcribe-1 se destaca em três eixos: WER menor (especialmente em ambientes ruidosos e em termos de domínio), inferência mais rápida e integração apertada com Azure / Copilot. Curto prazo, Whisper segue o padrão open source; MAI-Transcribe-1 vira o novo benchmark de API comercial.

| Dimensão | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| Open source | Não (API comercial) | Sim (MIT) | Sim (Apache 2.0) |

| Multilíngue | 25+ idiomas, CJK estável | 99 idiomas, mais fraco em cauda longa | EN + foco europeu |

| Áudio longo | Contexto nativo de 60+ min | Precisa de chunking | Contexto longo suportado |

| Latência | Significativamente menor que Whisper | Médio | Rápido |

| Deploy | Hospedado no Azure | Self-host ou cloud | Self-host open source |

| Preço | Por minuto | Open source (paga GPU) | Open source |

Conforme o blog Microsoft AI, a série MAI pretende consolidar o stack de voz em toda a IA full-stack da Microsoft (Search, Copilot, Office, Gaming, Bing) sobre tech first-party. Para apps a jusante, isso se traduz em SLAs mais estáveis e versionamento de modelo mais claro.

Para um produto como o BibiGPT — que não casa com nenhum modelo de voz único — o MAI-Transcribe-1 é mais uma opção no pool do motor de transcrição customizado, não um substituto.

O que significa para usuários do BibiGPT: uma base mais sólida para resumo de podcast

Resposta rápida: Três ganhos concretos para usuários do BibiGPT — transcrição mais precisa para podcasts e áudio longo, fluxo bilíngue de tradução de legendas mais fluido, e um pool mais rico de motores de transcrição customizados para escolher.

Caso 1: áudio de podcast / entrevista de longa duração

Áudio longo (>30 min) é o ponto fraco do Whisper — chunking perde contexto. O suporte nativo a contexto longo do MAI-Transcribe-1 significa que podcasts do Spotify e entrevistas de indústria transcrevem mais limpos. Veja o guia de fluxo de resumo de podcast com IA para comparativos.

Caso 2: conteúdo multilíngue cross-border

Notícias entre regiões, entrevistas JP / KR, reuniões bilíngues EN-CN — o WER multilíngue do MAI é mais estável em cenários mistos. Para criadores indo global ou pesquisadores cross-border, a cadeia de auto-tradução no upload (reconhecer → traduzir) ganha base de ASR mais precisa.

Caso 3: conteúdo de domínio denso em termos

Médico, jurídico, financeiro, técnico — terminologia densa há tempo se apoia em motores especializados como ElevenLabs Scribe. Adicionar MAI-Transcribe-1 amplia o pool, então usuários podem escolher o equilíbrio preço / precisão / idioma que melhor encaixa no conteúdo.

Como o BibiGPT planeja coexistir com a série MAI

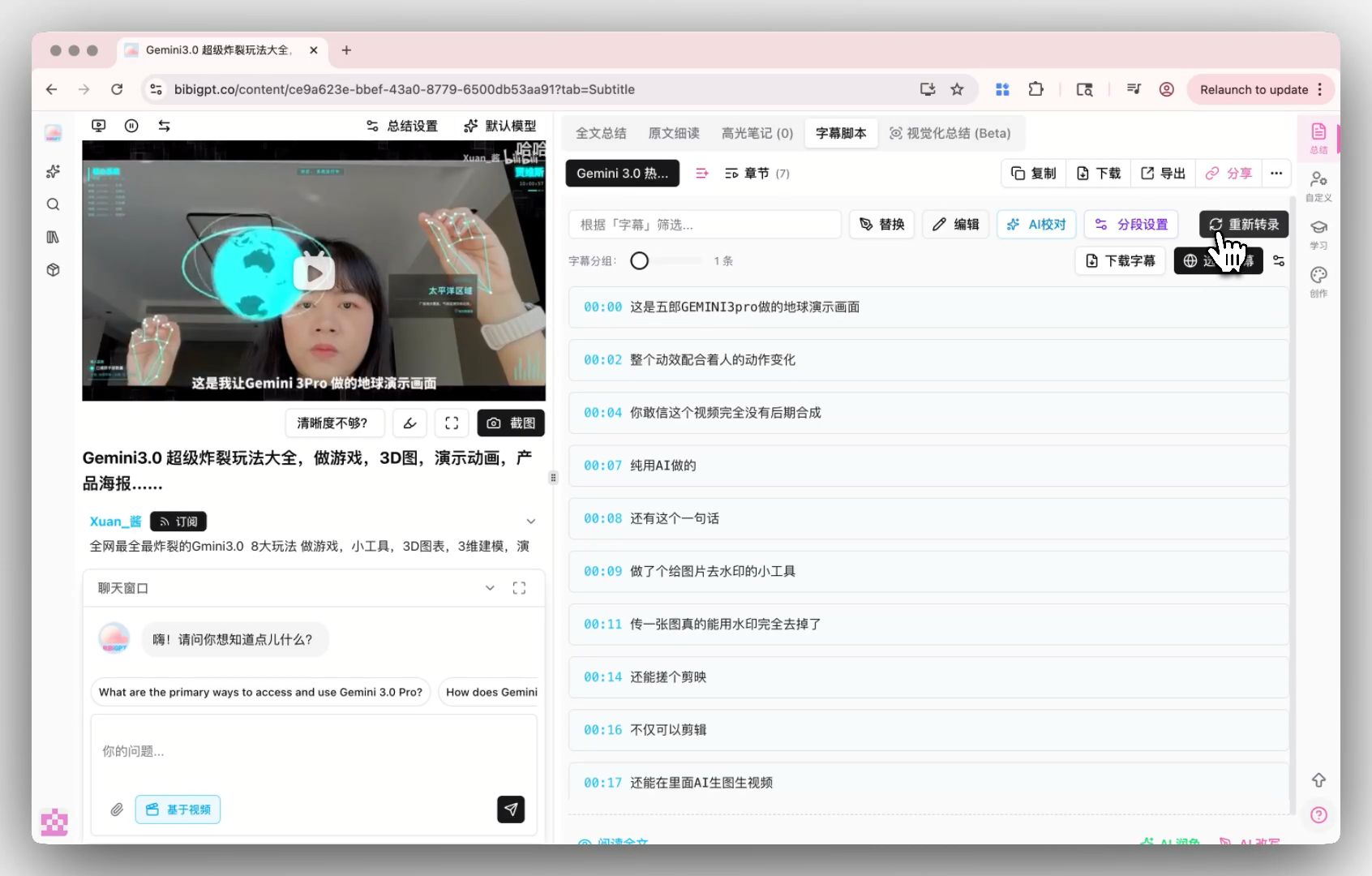

Resposta rápida: O posicionamento do BibiGPT nunca foi apostar em um único modelo de voz. MAI-Voice-1 / Transcribe-1 fazem o fluxo central do BibiGPT (transcrever → resumir → mapa mental → artigo / podcast) rodar sobre uma base mais sólida.

Caminho de compatibilidade: plugar MAI-Transcribe-1 no motor de transcrição customizado

O motor de transcrição customizado do BibiGPT hoje suporta OpenAI Whisper e o líder de indústria ElevenLabs Scribe. O MAI-Transcribe-1 é hoje só Azure / Copilot; quando APIs públicas amadurecerem, o BibiGPT vai avaliar adicioná-lo ao pool para usuários trocarem motores direto do editor de legenda.

Caminho complementar: MAI como base, BibiGPT como camada de artefato de conhecimento

Mesmo com o melhor ASR, a saída crua ainda é só texto. O valor único do BibiGPT mora a jusante da transcrição:

- Resumos estruturados + mapas mentais — divisão por capítulo de áudio longo

- Notas de destaque com IA — destaques com timestamp em um clique

- Resumo de coleção — síntese multi-episódio em um mapa de conhecimento

- Geração de podcast com dois apresentadores — resumo virado de volta em áudio, fechando o ciclo “podcast → podcast”

Essa arquitetura “trocar a base, manter a camada de produto” é o que permite ao BibiGPT absorver os melhores modelos de voz à medida que aparecem. Leitura mais profunda: Microsoft Copilot vs BibiGPT resumo de vídeo e a análise anterior sobre MAI-Transcribe-1 vs ASR open source da Cohere.

FAQ

Q1: O MAI-Transcribe-1 é open source? Posso fazer self-host?

R: Não. O MAI-Transcribe-1 é hoje uma oferta comercial via Azure / Copilot. Para self-hosting, fique com OpenAI Whisper (MIT) ou Mistral Voxtral (Apache 2.0).

Q2: O BibiGPT usa MAI-Transcribe-1 por padrão?

R: Ainda não. O BibiGPT hoje usa um pipeline híbrido in-house + Whisper; usuários podem trocar para ElevenLabs Scribe no motor de transcrição customizado. MAI-Transcribe-1 será avaliado quando APIs públicas amadurecerem.

Q3: O que MAI-Voice-1 significa para criadores de podcast?

R: Criadores poderão eventualmente usar TTS rápido como MAI-Voice-1 para reverter uma transcrição em áudio multi-host. A geração de podcast do BibiGPT já transforma um vídeo em conversa com dois apresentadores; TTS mais rápido vai derrubar a latência ainda mais.

Q4: Quanto melhor o MAI-Transcribe-1 é que o Whisper em podcasts em chinês?

R: Benchmarks públicos para chinês são limitados. Use o BibiGPT para rodar Whisper vs ElevenLabs Scribe lado a lado hoje; quando o MAI-Transcribe-1 abrir, o BibiGPT vai publicar comparativo prático.

Q5: Por que não colocar todo mundo no modelo mais forte por padrão?

R: Modelos diferentes trocam custo, precisão e cobertura de idioma. Amarrar um modelo único tiraria controle dos usuários em casos de borda (idiomas raros, termos de domínio). O motor de transcrição customizado devolve essa escolha para as mãos do usuário.

Encerramento

MAI-Voice-1 + MAI-Transcribe-1 da Microsoft marcam uma nova fase para modelos de voz fundacionais: first-party e baixa latência ponta a ponta. Para ferramentas de áudio-vídeo com IA, é um upgrade de stack inteiro — transcrição mais precisa, síntese mais rápida, áudio longo mais sólido.

A filosofia de produto do BibiGPT nunca foi travar em um modelo de voz — é transformar qualquer base forte em artefatos de conhecimento voltados ao usuário. Quando o MAI amadurecer, o BibiGPT vai adicionar ao pool do motor de transcrição customizado e seguir entregando os resumos com IA mais confiáveis para podcasts, vídeos cross-border e aprendizado de longa duração.

Comece agora sua jornada de aprendizado eficiente com IA:

- 🌐 Site oficial: https://aitodo.co

- 📱 Download mobile: https://aitodo.co/app

- 💻 Download desktop: https://aitodo.co/download/desktop

- ✨ Conheça mais recursos: https://aitodo.co/features

BibiGPT Team