DeepSeek-V4 jest tu! BibiGPT wprowadza cztery nowe modele + 1M kontekst pierwszego dnia — streszczanie wideo i podcastów AI właśnie weszło na wyższy poziom

DeepSeek-V4 jest tu! BibiGPT wprowadza cztery nowe modele + 1M kontekst pierwszego dnia — streszczanie wideo i podcastów AI właśnie weszło na wyższy poziom

Dziś (24 kwietnia 2026) DeepSeek-V4 Preview oficjalnie wystartował i jest w pełni open-source — 1M kontekst jest teraz domyślny, a zdolność agenta zamknęła lukę z Sonnet 4.5. BibiGPT zakończył integrację tego samego dnia, a DeepSeek V4 Pro, V4 Pro Thinking, V4 Flash i V4 Flash Thinking są teraz wybieralne bezpośrednio w selektorze modeli, gotowe na pełnometrażowy dokument, dwugodzinny wywiad lub cały sezon podcastu.

Od razu przepuściliśmy modele przez kilka rzeczywistych scenariuszy. Ten wpis to praktyczna notatka udostępniana w tym samym czasie, dla każdego pracującego z tego rodzaju treścią.

Spis treści

- Co nowego w DeepSeek-V4

- Cztery modele DeepSeek V4 dostępne w BibiGPT

- Przełącz na DeepSeek V4 w trzech krokach

- Praktyka: streszczanie własnego wideo startowego DeepSeek z V4 Pro

- Scenariusze, w których przełączenie na V4 stosuje się bezpośrednio

- Era AI: rzadkie nie są modele, ale to, jak szybko konsumujesz treść

- FAQ

Co nowego w DeepSeek-V4

DeepSeek-V4 przesuwa trzy kluczowe pokrętła naraz. Każde zasługuje na osobną notatkę.

Po pierwsze, 1M kontekst staje się domyślnym we wszystkich oficjalnych usługach DeepSeek. Nowy mechanizm uwagi kompresuje wzdłuż wymiaru tokenów i łączy się z DSA (DeepSeek Sparse Attention), by zmniejszyć koszt pamięci i obliczeń. W praktyce, podawanie godziny napisów nie wymaga już rutyny „dziel-i-zszywaj” — model czyta to jako jedno ciągłe ciało.

Po drugie, zdolność agenta robi wyraźny krok w górę. Według własnego pomiaru DeepSeek, V4-Pro prowadzi we wszystkich modelach open-source w Agentic Coding i dostarcza jakość zbliżoną do Opus 4.6 non-thinking; już używają go jako domyślnego wewnętrznego modelu kodowania. Dla codziennych użytkowników przekłada się to na bardziej niezawodne strukturyzowanie długich tekstów — podział na rozdziały, ekstrakcja kluczowych punktów, generowanie map myśli — z zauważalnie lepszą stabilnością.

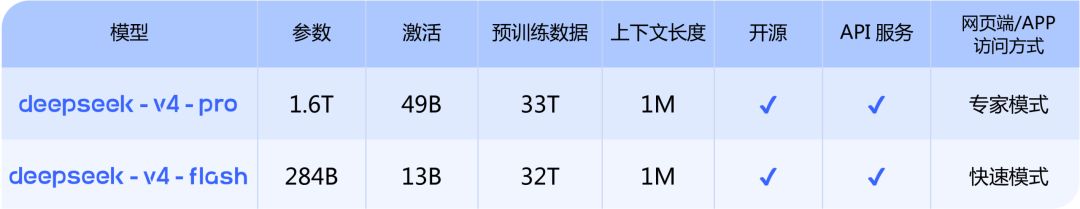

Po trzecie, Pro i Flash uzupełniają się. Pro (1,6T parametrów / 49B aktywnych / 33T tokenów pre-treningu) celuje w topowe modele closed-source; Flash (284B / 13B / 32T) to opcja efektywna kosztowo. Oba obsługują tryby thinking i non-thinking, a tryb thinking obsługuje strojenie reasoning_effort. Flash do prostych zadań, Pro do ciężkich — oba czują się solidnie.

Oryginalne ogłoszenie (po chińsku) jest tutaj: DeepSeek-V4 Preview: Era Miliona Tokenów wchodzi do mainstreamu. Wagi modelu są dostępne w kolekcji Hugging Face DeepSeek V4 (Pro / Pro-Base / Flash / Flash-Base, cztery repozytoria); raport techniczny jest w DeepSeek_V4.pdf.

Cztery modele DeepSeek V4 dostępne w BibiGPT

Otwórz dowolne ustawienia streszczania wideo lub audio, wpisz deepseek w selektorze modeli, a zobaczysz cztery nowe wpisy oznaczone New:

| Model | Zastosowanie | Thinking |

|---|---|---|

| DeepSeek V4 Pro | Najwyższa jakość dla długich, logicznie ciężkich treści | Non-thinking |

| DeepSeek V4 Pro Thinking | V4 Pro z jawnym rozumowaniem — agent i głęboka analiza | Thinking |

| DeepSeek V4 Flash | Efektywny kosztowo, świetny do krótkich i casualowych treści | Non-thinking |

| DeepSeek V4 Flash Thinking | Flash z rozumowaniem, balansuje szybkość i głębię | Thinking |

Który wybrać? Prosta zasada decyzyjna:

- Dłuższa treść (ponad godzina, pełne sezony podcastów, długie wywiady) → Pro lub Pro Thinking dla głębszego rozumowania w całym dziele

- Krótsza treść (poniżej 30 minut, spotkania, codzienne vlogi) → Flash, szybszy i bardziej ekonomiczny

- Chcesz, by model rozumował krok po kroku, porównywał punkty widzenia, szedł głębiej → wybierz wariant Thinking

- Potrzebujesz tylko czystego streszczenia, bez śladu rozumowania → wybierz wariant non-thinking

Jeśli nie chcesz uważnie porównywać, zacznij od V4 Pro Thinking — dostarcza spójne wyniki w większości scenariuszy długiej treści.

Przełącz na DeepSeek V4 w trzech krokach

- Otwórz BibiGPT, wklej link YouTube / podcastu / pliku lokalnego do pola wejściowego

- Kliknij Default Model poniżej wejścia, wpisz

deepseekw pasku wyszukiwania - Wybierz dowolny z czterech wpisów New i naciśnij przycisk streszczania

Wybór utrzymuje się między sesjami. Power users mogą przypiąć V4 Pro Thinking jako domyślne niestandardowe streszczenie, by każde przyszłe wideo automatycznie przez nie przechodziło.

Chcesz poczuć jakość streszczenia BibiGPT przed zmianą modeli? Wrzuć dowolny link do widgetu poniżej:

Praktyka: streszczanie własnego wideo startowego DeepSeek z V4 Pro

Pierwszą rzeczą, jaką zrobiliśmy, było uruchomienie V4 Pro na własnym wideo startowym DeepSeek. Trwa około półtorej minuty, a z włączonym trybem thinking model podzielił je na siedem strukturalnych rozdziałów, każdy z własnym streszczeniem, najważniejszymi punktami, refleksją i krytyczną recenzją.

Kilka szczegółów wartych wyróżnienia:

- Pełne pokrycie faktów: wszystkie pięć nagłówkowych twierdzeń z wydania (1M kontekst jako domyślny, skok agenta, prowadzenie w wiedzy o świecie, dwupoziomowa elastyczność, kompatybilność ekosystemu agenta) przeszły dokładnie, w tym liczby parametrów

- Każdy wniosek można wyśledzić: każdy punkt linkuje z powrotem do klikalnego znacznika czasu wideo, skacząc bezpośrednio do odpowiedniego momentu

- Pytania uzupełniające pojawiają się automatycznie: pod streszczeniem model sugeruje rozszerzenia jak „jaka jest różnica między dwoma poziomami V4” i „jak je wywołać przez API”, gotowe do dogłębnego zanurzenia jednym dotknięciem

Poprawa tutaj pochodzi głównie z głębszego rozumowania trybu thinking. Długi kontekst jest już domyślną ścieżką we wszystkich głównych modelach w BibiGPT, a przybycie V4 wprowadza tę kombinację „głębokie rozumowanie + stabilność pełnej transkrypcji” do warstwy open-source w pierwszorzędnej jakości.

Scenariusze, w których przełączenie na V4 stosuje się bezpośrednio

Modele open-source ciągle spadają. Mógłbyś zapytać: czy nie mogę po prostu użyć strony DeepSeek lub API bezpośrednio? Po co kierować przez BibiGPT?

Sprowadza się to do scenariusza. Strona DeepSeek to ogólny chatbox — wciąż musisz pobrać wideo, transkrybować, wkleić i wymyślić, jak prompować. BibiGPT robi jedną rzecz od lat: sprawia, by długie wideo i podcasty były tak łatwe w konsumpcji, jak czytanie artykułu. V4 to najnowsza zdolność dodana do tego stosu; tym, co faktycznie sprawia, że „wklej link, otrzymaj prawdziwe zrozumienie” działa, jest warstwa produktu, którą udoskonalaliśmy wokół modelu.

Wewnątrz BibiGPT następujące zdolności bezpośrednio podążają za modelem wybranym jako twój „Default Model” — innymi słowy, gdy przełączysz się na DeepSeek V4, te funkcje działają na V4.

📝 Streszczenia wideo (Default + Custom Prompt)

Rzecz, której używasz najczęściej — naciskanie „Summarize” po wklejeniu linku — działa na dowolnym modelu, który wybrałeś. Wszelkie zapisane niestandardowe prompty (rzeczy jak „Counterintuitive Analyst”, „Critical Thinking” lub „Investment Analyst”) również przechodzą przez ten sam model. Przełącz się na DeepSeek V4 Pro Thinking, ponów to samo wideo z tym samym promptem, i otrzymasz bezpośrednie porównanie obok siebie głębokości rozumowania i struktury. To jeden ze scenariuszy, który sami wciąż badamy — uruchom go na własnej treści i zobacz, czy wynik lepiej pasuje do twoich oczekiwań.

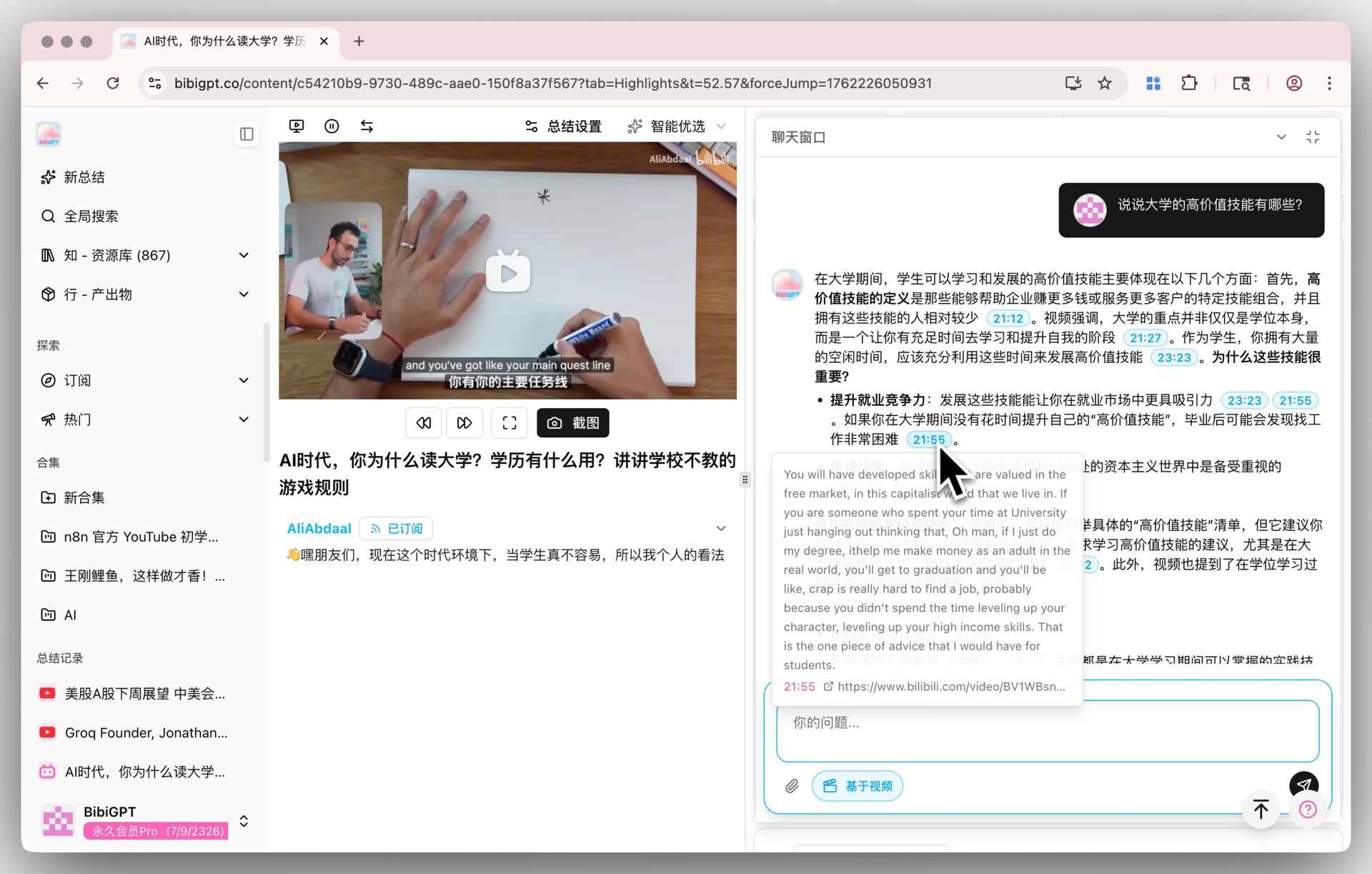

🎯 AI Video Chat z śledzeniem źródła

Okno czatu pod stroną szczegółów wideo również podąża za domyślnym modelem. Każda odpowiedź niesie klikalny znacznik czasu — „uczynił przeciwny punkt o 1:12:30”, jedno dotknięcie i tam skaczesz. Po przełączeniu na V4 wybierz wywiad 1+ godziny i zadaj kilka rund pytań uzupełniających — to scenariusz, w którym różnice między modelami zwykle szybko się ujawniają, i wart jest pierwszorocznego uruchomienia.

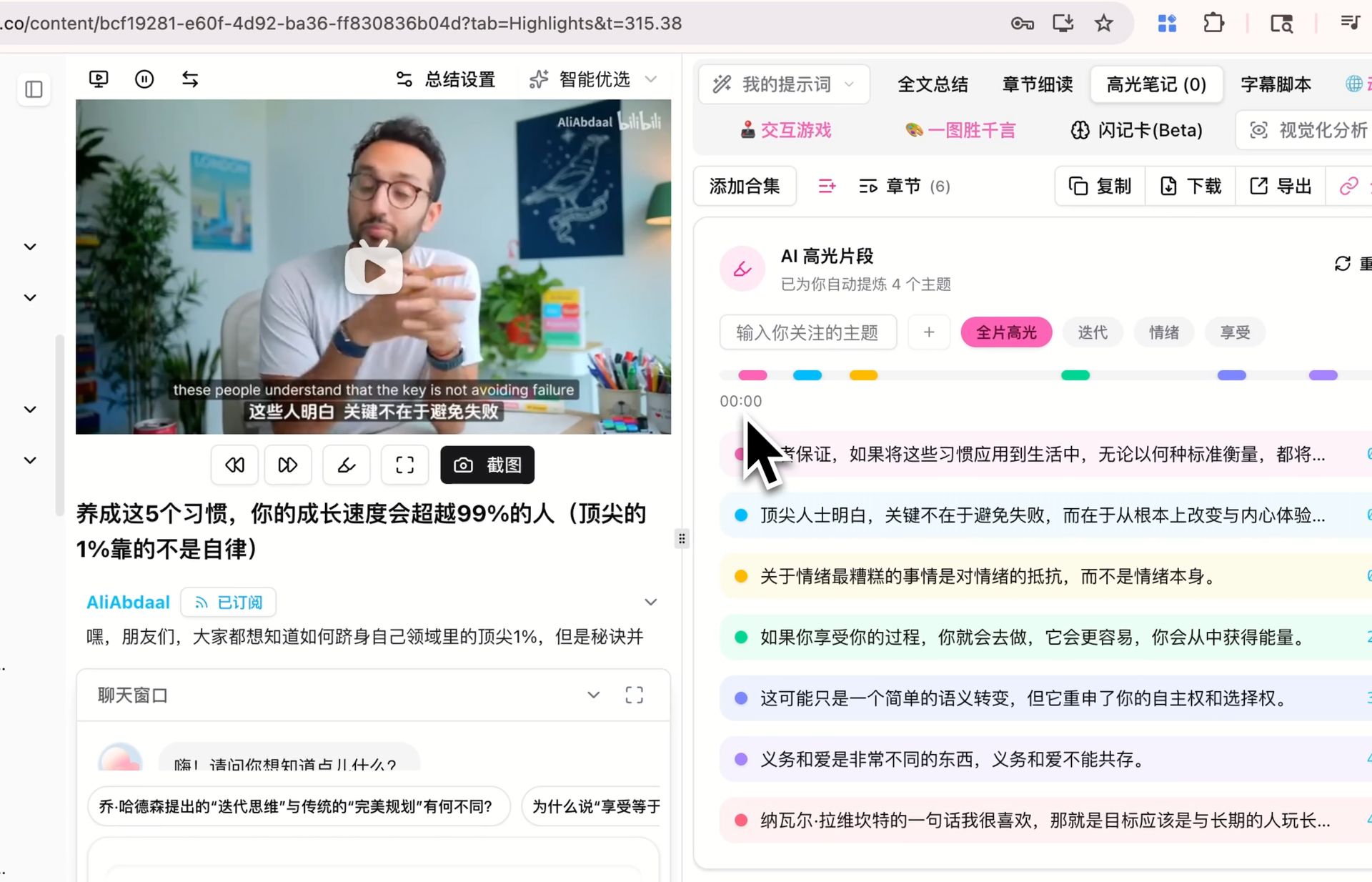

🔖 AI Highlight Notes

Ekstrakcja klipów wyróżniających z wideo z znacznikami czasu — pogrupowanych według tematu — również działa na domyślnym modelu. Jeśli już wygenerowałeś notatki wyróżniające dla jakiegoś wideo na innym modelu, ponów je na V4 i porównaj, które klipy zostały oznaczone jako wyróżnienia i jak grupują się tematy. Czy różnica jest znacząca w twojej treści, najłatwiej ocenić, robiąc to samodzielnie.

Wszystkie trzy to scenariusze, które sami wciąż oceniamy — wyniki różnią się między różnymi treściami, promptami i językami, a najbardziej niezawodna ocena to ta, którą formułujesz po kilku uruchomieniach wewnątrz własnego workflow.

Kilka innych obszarów używa dedykowanych modeli — analiza wizualna treści działa na modelu wizji, a wideo-do-ilustrowanego-artykułu używa stałego pipeline’u — więc nie reagują na przełącznik domyślnego modelu i nie są częścią powyższego porównania.

BibiGPT obsłużył 1M+ użytkowników i wygenerował dotychczas 5M+ streszczeń AI. Ta skala pomaga nam szybko mapować każdy nowy model na rzeczywiste scenariusze, zamiast pozostawać w warstwie porównań benchmarkowych.

Era AI: rzadkie nie są modele, ale to, jak szybko konsumujesz treść

W 2026 modele AI są zasadniczo jak bieżąca woda — DeepSeek V4, Gemini 3.1 Pro, Claude Opus 4.6 są wszystkie w zasięgu. Modele nie są już rzadkie.

Co jest rzadkie? Jak szybko zamieniasz informację w opinie, a opinie w działanie.

Audio i wideo to format o najniższej gęstości i najdłuższej konsumpcji w internecie. Dwugodzinny wywiad transkrybowany to 8 000 słów, ale prawdziwa teza może mieć 300. 30-godzinny sezon podcastu daje może 20 trwałych cytatów. Przez lata jedyną sztuczką była prędkość 1,5x lub 2x — wymiana uwagi za gęstość. Z najnowszymi modelami matematyka się odwraca:

- Koniec z biernym słuchaniem, po prostu zadawaj pytania, które cię interesują — model wyciąga odpowiedzi z transkrypcji

- Bez konieczności kończenia przed osądem, najpierw przeczytaj streszczenie, potem zdecyduj, czy zasługuje na godzinę

- Koniec z przerzucaniem jednego wideo na raz, wyszukuj we wszystkich — „kto z 100 twórców, których śledzę, mówił o tym temacie”

BibiGPT robi jedną rzecz: podpina najlepszy dostępny model do największego, ale najtrudniejszego w konsumpcji formatu — audio i wideo — by każdy mógł skompresować dwie godziny wideo w piętnaście minut wysokogęstego czytania. DeepSeek V4 dodaje jeszcze jedną niezawodną opcję do tego stosu.

FAQ

P1: Jaka jest różnica między DeepSeek V4 Pro a V4 Pro Thinking?

Podstawowa różnica to czy rozumowanie jest jawne. Non-thinking ma niższe opóźnienie z krótszym wyjściem, dobry do czystego streszczenia. Tryb thinking generuje najpierw łańcuch rozumowania — lepszy do logiki wielokrokowej, porównania międzyrozdziałowego lub analizy argumentów. Możesz dostroić głębokość z reasoning_effort=high/max; głębsze rozumowanie, wolniejsze wyjście.

P2: Czy wybrać V4 Pro czy V4 Flash?

Myśl w kategoriach „długość × złożoność rozumowania”. Ponad godzina lub rozumowanie wielokrokowe → Pro. Poniżej trzydziestu minut i czyste streszczenie wystarczy → Flash. W razie wątpliwości zacznij od Flash i przełącz na Pro, jeśli okaże się niewystarczający — BibiGPT cache’uje transkrypcję, więc ponowne streszczanie całkowicie pomija krok transkrypcji.

P3: Po co przechodzić przez BibiGPT zamiast używać strony DeepSeek bezpośrednio?

Strona DeepSeek to ogólny chatbox — wciąż musisz pobrać, transkrybować, wkleić i sam prompować. BibiGPT obsługuje upstream pipeline (parsowanie linków z 30+ platform, transkrypcję, analizę wizualną, wyrównanie znaczników czasu), a DeepSeek V4 musi pokryć tylko końcowy krok zrozumienia-i-generowania. To samo wejście, a dodatkowo otrzymujesz mapy myśli, notatki wyróżniające, ilustrowane artykuły i strukturalne eksporty bez żadnego dodatkowego montażu.

P4: Jak długie wideo może obsłużyć DeepSeek V4?

V4 Pro i Flash mają oba 1M token kontekstu — z grubsza 1,5 miliona chińskich znaków lub ponad 20 godzin dialogu — wystarczająco na pełny sezon podcastu. BibiGPT automatycznie decyduje między streszczaniem jednoprzebiegowym a podział-potem-konsolidacja w oparciu o efektywny kontekst modelu.

P5: Czy wagi DeepSeek V4 są open-source?

W pełni open-source. Wagi są na Hugging Face deepseek-ai/deepseek-v4 i ModelScope; raport techniczny jest w DeepSeek_V4.pdf. Badacze i self-hosterzy mogą je pobrać bezpośrednio.

Wypróbuj V4 teraz

Najbardziej bezpośredni sposób, by poczuć V4: wybierz długie wideo, które miałeś zamiar faktycznie obejrzeć — wykład, odcinek podcastu, dokument, cokolwiek — i przepuść je przez DeepSeek V4 Pro Thinking. Zobacz, jak V4 obsługuje coś, co cię naprawdę interesuje.

Zacznij swoją podróż efektywnej nauki AI teraz:

- 🌐 Oficjalna strona: https://aitodo.co

- 📱 Pobranie mobilne: https://aitodo.co/app

- 💻 Pobranie desktopowe: https://aitodo.co/download/desktop

- ✨ Poznaj więcej funkcji: https://aitodo.co/features

BibiGPT Team