DeepSeek-V4 è arrivato! BibiGPT rilascia quattro nuovi modelli + contesto 1M lo stesso giorno — i riassunti video e podcast con IA fanno un salto di livello

DeepSeek-V4 è arrivato! BibiGPT rilascia quattro nuovi modelli + contesto 1M lo stesso giorno — i riassunti video e podcast con IA fanno un salto di livello

Oggi (24 aprile 2026) DeepSeek-V4 Preview è stato lanciato ufficialmente ed è completamente open-source — il contesto 1M è ora il default, e la capacità agent ha colmato il divario con Sonnet 4.5. BibiGPT ha completato l’integrazione lo stesso giorno, e DeepSeek V4 Pro, V4 Pro Thinking, V4 Flash e V4 Flash Thinking sono ora selezionabili direttamente dal selettore di modello, pronti per un documentario completo, un’intervista di due ore o un’intera stagione di podcast.

Abbiamo subito provato i modelli su alcuni scenari reali. Questo articolo è una nota pratica condivisa nello stesso momento, per chiunque lavori con lo stesso tipo di contenuti.

Indice

- Cosa c’è di nuovo in DeepSeek-V4

- I quattro modelli DeepSeek V4 ora attivi in BibiGPT

- Passa a DeepSeek V4 in tre passi

- Hands-on: riassumere il video di lancio di DeepSeek con V4 Pro

- Scenari in cui passare a V4 si applica direttamente

- L’era dell’IA: ciò che scarseggia non sono i modelli, ma quanto velocemente consumi i contenuti

- FAQ

Cosa c’è di nuovo in DeepSeek-V4

DeepSeek-V4 muove tre leve chiave contemporaneamente. Ognuna merita una nota a parte.

Primo, il contesto 1M diventa il default in tutti i servizi ufficiali DeepSeek. Il nuovo meccanismo di attenzione comprime lungo la dimensione dei token e si combina con DSA (DeepSeek Sparse Attention) per ridurre i costi di memoria e calcolo. In termini pratici, dare in pasto un’ora di sottotitoli non richiede più la routine “spezzetta-e-ricuci” — il modello legge tutto come un corpo unico continuo.

Secondo, la capacità agent compie un chiaro passo avanti. Secondo la misurazione di DeepSeek stesso, V4-Pro è in testa fra tutti i modelli open-source su Agentic Coding e offre qualità vicina a Opus 4.6 non-thinking; lo usano già come modello di coding interno di default. Per gli utenti quotidiani, questo si traduce in una strutturazione di testi lunghi più affidabile — capitolazione, estrazione di punti chiave, generazione di mappe mentali — con una stabilità nettamente migliore.

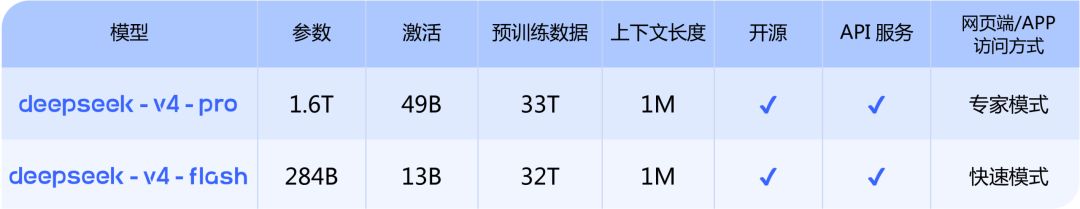

Terzo, Pro e Flash si completano a vicenda. Pro (1,6T parametri / 49B attivi / 33T token di pre-training) punta ai migliori modelli closed-source; Flash (284B / 13B / 32T) è l’opzione cost-efficient. Entrambi supportano modalità thinking e non-thinking, e la modalità thinking supporta il tuning di reasoning_effort. Flash per task semplici, Pro per quelli pesanti — entrambi sono solidi.

L’annuncio originale (in cinese) è qui: DeepSeek-V4 Preview: l’era del milione di token diventa mainstream. I pesi del modello sono disponibili nella collezione Hugging Face DeepSeek V4 (Pro / Pro-Base / Flash / Flash-Base, quattro repo); il technical report è in DeepSeek_V4.pdf.

I quattro modelli DeepSeek V4 ora attivi in BibiGPT

Apri le impostazioni di qualsiasi riassunto video o audio, scrivi deepseek nel selettore di modello, e vedrai quattro nuove voci taggate New:

| Modello | Caso d’uso | Thinking |

|---|---|---|

| DeepSeek V4 Pro | Qualità di altissimo livello per contenuti lunghi e logicamente densi | Non-thinking |

| DeepSeek V4 Pro Thinking | V4 Pro con reasoning esplicito — agent e analisi profonda | Thinking |

| DeepSeek V4 Flash | Cost-efficient, ottimo per contenuti brevi e informali | Non-thinking |

| DeepSeek V4 Flash Thinking | Flash con reasoning, bilancia velocità e profondità | Thinking |

Quale scegliere? Una semplice regola di decisione:

- Contenuti più lunghi (oltre un’ora, intere stagioni di podcast, lunghe interviste) → Pro o Pro Thinking per un reasoning più profondo sull’intera opera

- Contenuti più brevi (sotto 30 minuti, riunioni, vlog quotidiani) → Flash, più veloce ed economico

- Vuoi che il modello ragioni passo passo, confronti i punti di vista, vada più a fondo → scegli una variante Thinking

- Hai solo bisogno di un riassunto pulito, senza traccia di ragionamento → scegli una variante non-thinking

Se non vuoi confrontare con cura, parti da V4 Pro Thinking — offre risultati consistenti nella maggior parte degli scenari di contenuti lunghi.

Passa a DeepSeek V4 in tre passi

- Apri BibiGPT, incolla un link YouTube / podcast / file locale nella casella di input

- Clicca Modello di default sotto l’input, scrivi

deepseeknella barra di ricerca - Scegli una qualsiasi delle quattro voci New e premi il pulsante di riassunto

La selezione persiste tra le sessioni. I power user possono fissare V4 Pro Thinking come riassunto personalizzato di default, così ogni futuro video lo userà automaticamente.

Vuoi sentire la qualità dei riassunti BibiGPT prima di cambiare modello? Lascia un link qualsiasi nel widget qui sotto:

Hands-on: riassumere il video di lancio di DeepSeek con V4 Pro

La prima cosa che abbiamo fatto è stata far girare V4 Pro sul video di lancio di DeepSeek stesso. Dura circa un minuto e mezzo, e con la modalità thinking attivata, il modello l’ha suddiviso in sette capitoli strutturati, ognuno con il proprio riassunto, highlights, riflessione e revisione critica.

Alcuni dettagli che vale la pena menzionare:

- Copertura completa dei fatti: tutte e cinque le affermazioni principali del rilascio (contesto 1M come default, salto agent, vantaggio di world-knowledge, flessibilità dual-tier, compatibilità ecosistema agent) sono passate accuratamente, inclusi i numeri dei parametri

- Ogni conclusione è tracciabile: ogni punto rimanda a un timestamp video cliccabile, saltando direttamente al momento rilevante

- Le domande di follow-up appaiono automaticamente: sotto il riassunto il modello suggerisce estensioni come “qual è la differenza tra i due tier V4” e “come li chiamo tramite API”, pronti per un approfondimento con un solo tocco

Il miglioramento qui viene principalmente dal reasoning più profondo della modalità thinking. Il contesto lungo è già un percorso di default tra i principali modelli in BibiGPT, e l’arrivo di V4 porta quella combinazione “reasoning profondo + stabilità sull’intera trascrizione” nel tier open-source con qualità di prim’ordine.

Scenari in cui passare a V4 si applica direttamente

I modelli open-source continuano a uscire. Potresti chiedere: non posso usare direttamente il sito DeepSeek o l’API? Perché passare per BibiGPT?

Si riduce allo scenario. Il sito DeepSeek è una chatbox generica — devi comunque scaricare il video, trascrivere, incollare e capire come fare prompt. BibiGPT da anni fa una cosa: rendere video e podcast lunghi facili da consumare come leggere un articolo. V4 è la capacità più recente aggiunta a quello stack; ciò che fa davvero funzionare “incolla un link, ottieni vera comprensione” è il livello di prodotto che abbiamo affinato attorno al modello.

Dentro BibiGPT, le seguenti capacità seguono direttamente il modello che selezioni come “Modello di default” — in altre parole, una volta passato a DeepSeek V4, queste funzionalità girano su V4.

📝 Riassunti video (Default + Prompt personalizzato)

Quello che usi più spesso — premere “Riassumi” dopo aver incollato un link — gira sul modello che hai selezionato. Anche tutti i prompt personalizzati salvati (cose come “Analista controintuitivo”, “Pensiero critico” o “Analista di investimenti”) passano per lo stesso modello. Passa a DeepSeek V4 Pro Thinking, riesegui lo stesso video con lo stesso prompt, e ottieni un confronto side-by-side diretto su profondità di reasoning e struttura. Questo è uno degli scenari che stiamo ancora esplorando noi stessi — provalo sui tuoi contenuti e vedi se il risultato si adatta meglio alle tue aspettative.

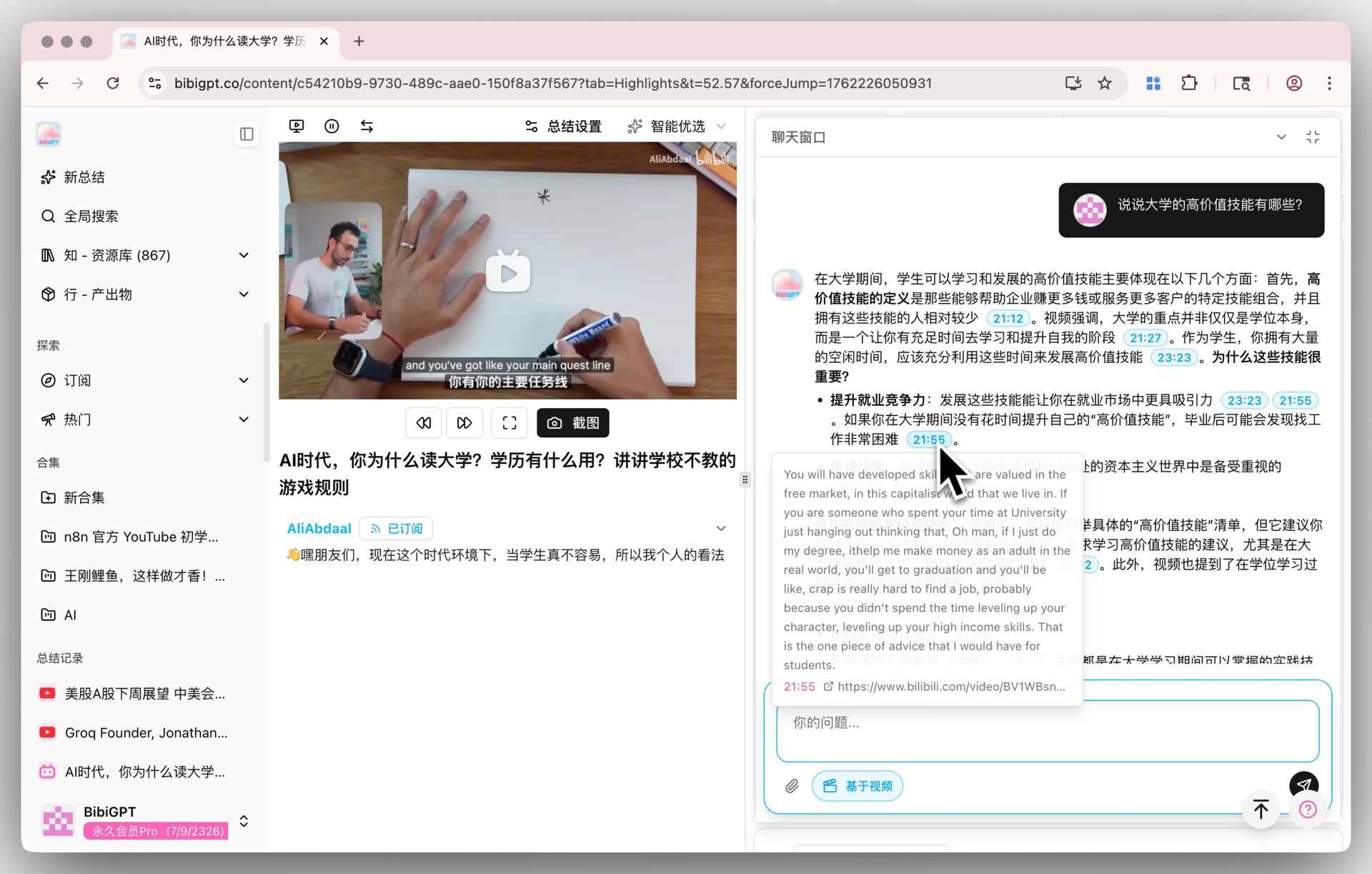

🎯 AI Video Chat con tracciamento delle fonti

Anche la finestra di chat sotto la pagina di dettaglio del video segue il modello di default. Ogni risposta porta un timestamp cliccabile — “ha fatto il punto opposto a 1:12:30”, un tocco e ci salti. Una volta passato a V4, scegli un’intervista da 1+ ora e fai qualche giro di domande di follow-up — questo è uno scenario in cui le differenze tra modelli tendono ad emergere rapidamente, e vale la pena un test diretto.

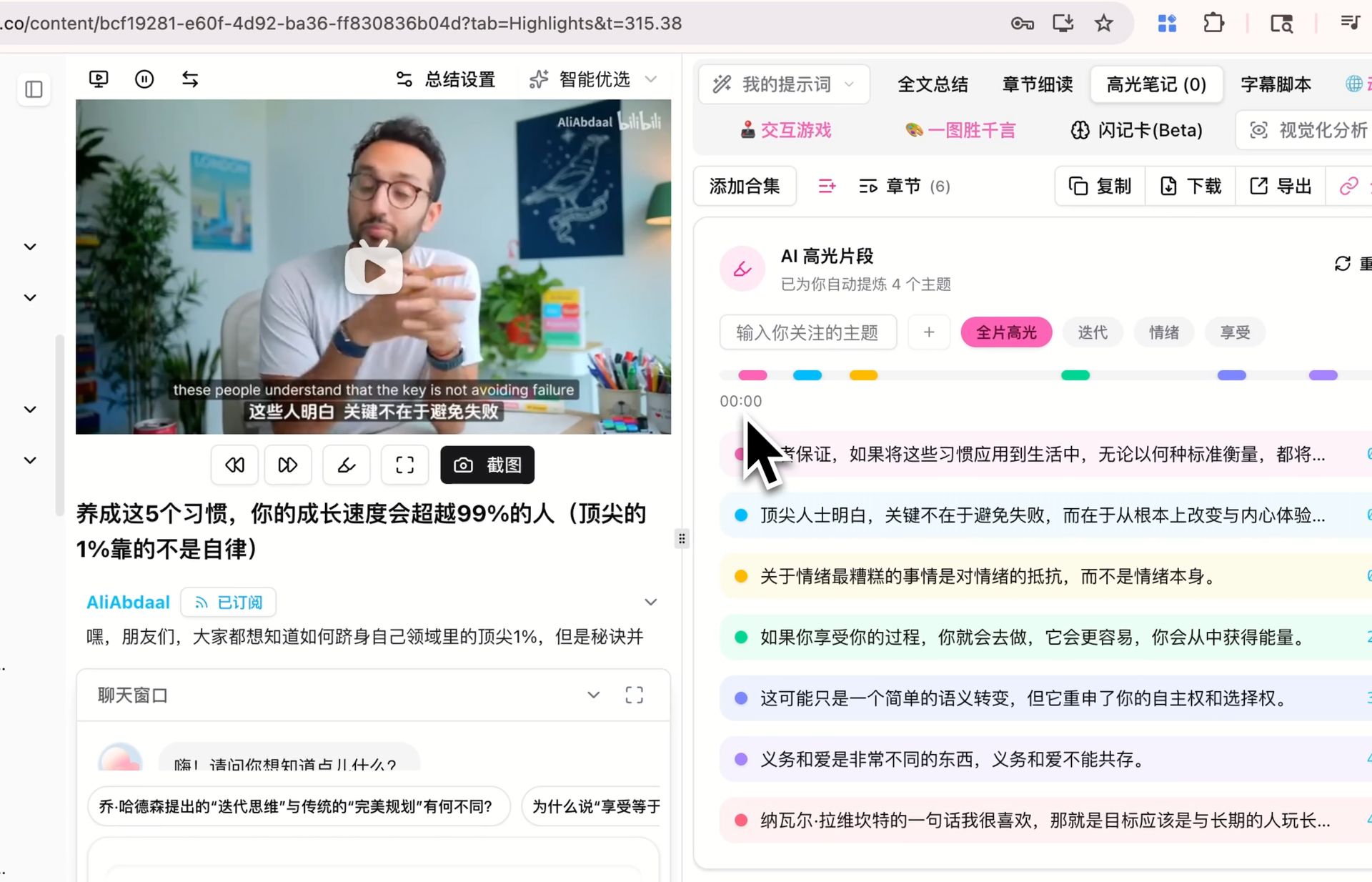

🔖 Note di highlight con IA

Estrarre i clip di highlight da un video con i timestamp — raggruppati per argomento — gira anch’esso sul modello di default. Se hai già generato note di highlight per qualche video con un altro modello, rieseguili su V4 e confronta quali clip vengono marcati come highlight e come si raggruppano gli argomenti. Se la differenza è significativa sui tuoi contenuti è più facile giudicarlo facendolo da soli.

Tutti e tre sono scenari che stiamo ancora valutando noi stessi — i risultati variano tra contenuti, prompt e lingue diverse, e la valutazione più affidabile è quella che ti formi dopo qualche prova all’interno del tuo workflow.

Un paio di altre aree usano modelli dedicati — l’analisi del contenuto visivo gira su un modello visivo, e il video-to-illustrated-article usa una pipeline fissa — quindi non rispondono al cambio di modello di default e non fanno parte del confronto qui sopra.

BibiGPT ha servito 1M+ utenti e generato 5M+ riassunti IA finora. Quella scala ci aiuta a mappare ogni nuovo modello su scenari del mondo reale rapidamente, invece di restare al livello di confronto tra benchmark.

L’era dell’IA: ciò che scarseggia non sono i modelli, ma quanto velocemente consumi i contenuti

Nel 2026, i modelli IA sono essenzialmente come l’acqua corrente — DeepSeek V4, Gemini 3.1 Pro, Claude Opus 4.6 sono tutti a portata di mano. I modelli non sono più scarsi.

Cosa è scarso? Quanto velocemente trasformi le informazioni in opinioni, e le opinioni in azione.

Audio e video sono il formato a più bassa densità e più lungo da consumare su internet. Un’intervista di due ore trascritta è 8.000 parole, ma la vera tesi potrebbe essere 300. Una stagione di podcast da 30 ore produce forse 20 citazioni durature. Per anni l’unico trucco è stata la riproduzione a 1,5x o 2x — barattare attenzione per densità. Con i modelli più recenti, la matematica si capovolge:

- Niente più ascolto passivo, basta porre le domande che ti interessano — il modello tira fuori le risposte dalla trascrizione

- Non c’è bisogno di finire prima di giudicare, leggi prima il riassunto, poi decidi se merita l’ora

- Niente più sfogliare un video alla volta, cerca tra tutti — “chi tra i 100 creator che seguo ha parlato di questo argomento”

BibiGPT fa una cosa: collega il miglior modello disponibile al formato più grande ma più difficile da consumare — audio e video — così chiunque può comprimere due ore di video in quindici minuti di lettura ad alta densità. DeepSeek V4 aggiunge un’altra opzione affidabile a quello stack.

FAQ

Q1: Qual è la differenza tra DeepSeek V4 Pro e V4 Pro Thinking?

La differenza centrale è se il reasoning è esplicito. Non-thinking ha latenza più bassa con output più corto, buono per un riassunto pulito. La modalità thinking genera prima una catena di reasoning — meglio per logica multi-step, confronto cross-chapter o analisi di argomenti. Puoi regolare la profondità con reasoning_effort=high/max; reasoning più profondo, output più lento.

Q2: Devo scegliere V4 Pro o V4 Flash?

Pensa in termini di “lunghezza × complessità del reasoning”. Oltre un’ora o reasoning multi-step → Pro. Sotto trenta minuti e basta un riassunto pulito → Flash. In caso di dubbio, parti da Flash e passa a Pro se non basta — BibiGPT mette in cache la trascrizione, così rifare il riassunto salta interamente lo step di trascrizione.

Q3: Perché passare per BibiGPT invece di usare direttamente il sito DeepSeek?

Il sito DeepSeek è una chatbox generica — devi comunque scaricare, trascrivere, incollare e fare prompt da solo. BibiGPT gestisce la pipeline upstream (parsing di link da 30+ piattaforme, trascrizione, analisi visiva, allineamento dei timestamp), e DeepSeek V4 deve solo coprire lo step finale di comprensione e generazione. Stesso input, e in più ottieni mappe mentali, note di highlight, articoli illustrati ed esportazioni strutturate senza alcun assemblaggio extra.

Q4: Quanto può essere lungo un video che DeepSeek V4 può gestire?

V4 Pro e Flash hanno entrambi contesto 1M token — circa 1,5 milioni di caratteri cinesi, o oltre 20 ore di dialogo — sufficienti per un’intera stagione di podcast. BibiGPT decide automaticamente tra riassunto in singolo passaggio e chunk-poi-consolida in base al contesto effettivo del modello.

Q5: I pesi di DeepSeek V4 sono open-source?

Completamente open-source. I pesi sono su Hugging Face deepseek-ai/deepseek-v4 e ModelScope; il technical report è in DeepSeek_V4.pdf. Ricercatori e self-hoster possono scaricarli direttamente.

Prova V4 ora

Il modo più diretto per sentire V4: scegli un video lungo che hai sempre voluto guardare davvero — una lezione, un episodio di podcast, un documentario, qualunque cosa — ed eseguilo con DeepSeek V4 Pro Thinking. Vedi come V4 gestisce qualcosa che ti sta davvero a cuore.

Inizia subito il tuo viaggio di apprendimento efficiente con IA:

- 🌐 Sito ufficiale: https://aitodo.co

- 📱 Download mobile: https://aitodo.co/app

- 💻 Download desktop: https://aitodo.co/download/desktop

- ✨ Scopri altre funzionalità: https://aitodo.co/features

BibiGPT Team