BibiGPT v4.361 Update: KI-Modell-Roster aufgefrischt, GPT Image 2 in KI-Bildgenerierung, Vision-Analyse-Trio

BibiGPT v4.361 Update: KI-Modell-Roster aufgefrischt, GPT Image 2 in KI-Bildgenerierung, Vision-Analyse-Trio

Liebe BibiGPT-Nutzer,

Wir haben diese Woche viel ausgeliefert — und der rote Faden ist „Video schneller konsumieren als Text lesen”. Auf der Modell-Schicht kamen drei Flaggschiff-Releases in einer einzigen Woche an (GPT-5.5, DeepSeek V4 Pro, MiMo V2.5), und wir waren auf jedem live, sobald es ausgeliefert wurde — und OpenAIs GPT Image 2 landete ebenfalls in unserer KI-Bildgenerierungs-Pipeline. Auf der Erfahrungs-Schicht erhielt die Vision-Analyse die Art von Detailpolitur, die leise Reibung entfernt. Jede einzelne Änderung ist klein. Zusammen gestapelt fließen Dinge, die früher drei Fenster, eine 30-Sekunden-Wartezeit und zwei Einstellungs-Umstellungen brauchten, jetzt in einem Zug.

⚡ Schneller zu schauen

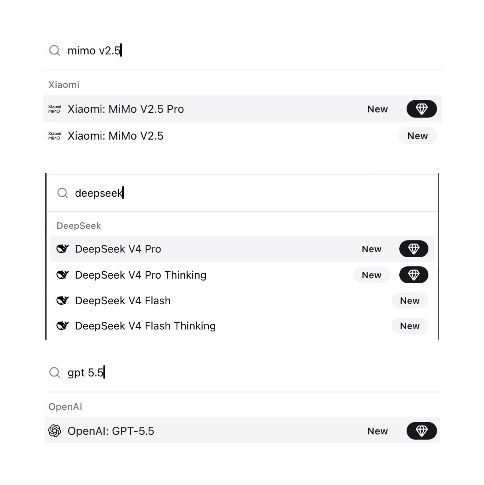

KI-Modell-Roster aufgefrischt: GPT-5.5 / DeepSeek V4 Pro / MiMo V2.5, am Tag eins

Die Modell-Schicht hatte diese Woche einen seltenen Lauf von Back-to-Back-Releases. Plus- / Pro-Mitglieder können in dem Moment wechseln, in dem jedes ausgeliefert wird — keine Notwendigkeit, eigene Schlüssel mitzubringen:

- GPT-5.5 / GPT-5.5 Pro (OpenAI, veröffentlicht 23.04.2026) — 1M Kontextfenster. Lange Vorlesungen und 2-stündige Streams werden nicht mehr abgeschnitten.

- DeepSeek V4 Pro / V4 Flash (mit Thinking-Varianten, veröffentlicht 24.04.2026) — 1M Kontext, freundliche Preise. Wir haben auch das Standard-Kapitel-Zusammenfassungsmodell auf V4 Pro hochgesetzt, sodass bestehende Nutzer automatisch Qualitätsgewinn sehen.

- MiMo V2.5 (Xiaomi, Open-Source, 1M Kontext) — Best-in-Class bei Preis-Leistung.

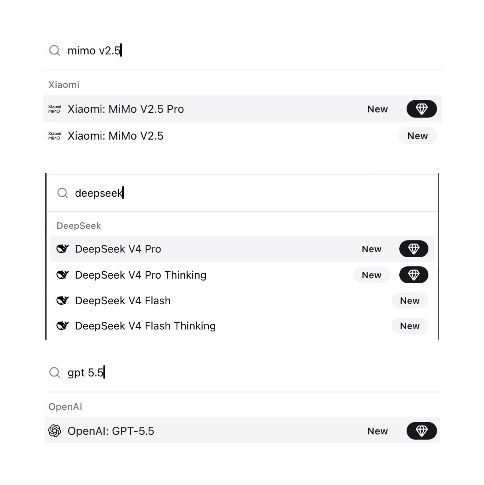

Mit mehr Modellen auf dem Roster hat der Auswähler jetzt einen Schalter „Legacy-Modelle anzeigen” in der oberen rechten Ecke. Ältere Versionen (GPT-4o, Claude 3 usw.) sind standardmäßig versteckt — aus dem Weg, aber einen Klick entfernt, falls Sie sie brauchen.

Modelle sind nicht mehr knapp — die Geschwindigkeit, mit der Sie Inhalt konsumieren, schon. Derselbe 2-stündige Finanz-Livestream kann von den neuesten Modellen auf 30 Sekunden knackiger Kapitel reduziert werden. Tag-Eins-Integration ist einfach BibiGPTs Standardeinstellung; überlassen Sie es uns, und Sie erhalten das neueste Modell in dem Moment, in dem es ausgeliefert wird.

🔎 Leichter zu finden

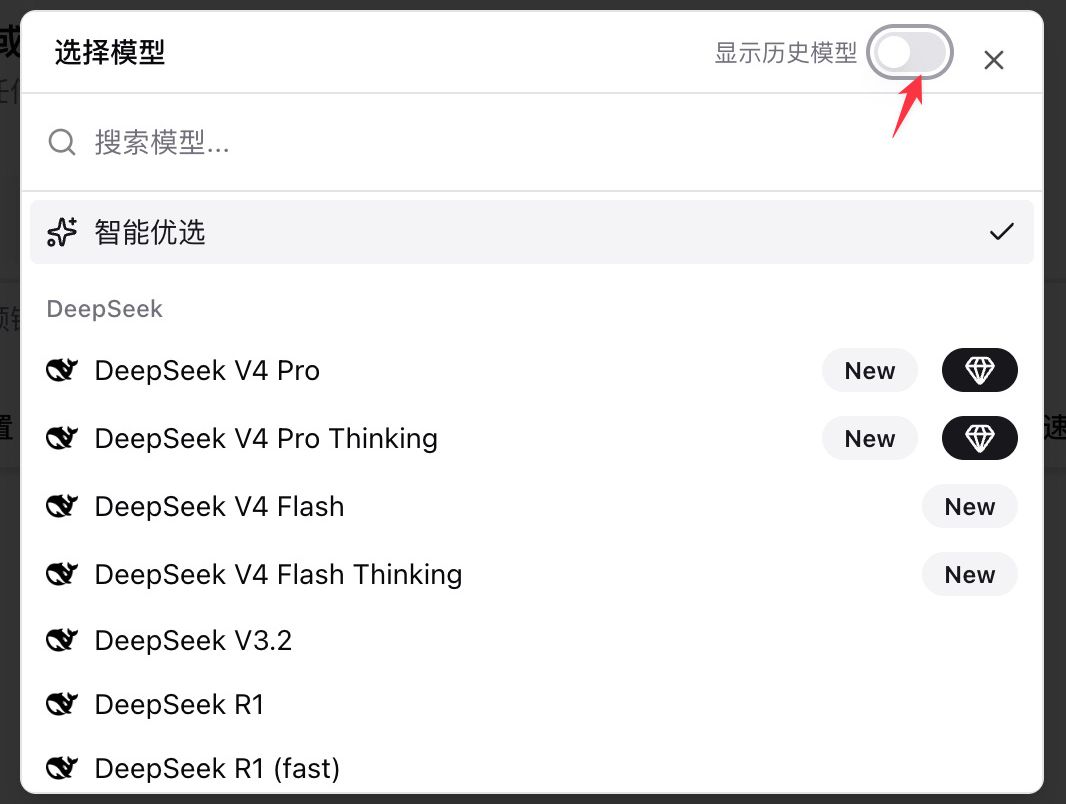

/apps — Vereinheitlichter Kanal-Hub

„Wo lade ich den Desktop-Client / die Chrome-Erweiterung / iOS-App herunter?” — wir hören das ständig. Das neue aitodo.co/apps klappt jeden Kanal auf einer Seite zusammen:

- Mobile — iOS / Android / WeChat-Assistent / offizielles Konto, alle in einem Klick erreichbar

- Desktop — Desktop-Client / Browser-Erweiterung / PWA-Installation

- Entwicklerbereich — Agent Skill / Remote MCP / Open API separat als fortgeschrittene Einstiege gelistet

Zwei dedizierte Landingpages gingen ebenfalls live: /apps/browser für Ein-Klick-Chrome- / Edge- / Firefox-Erweiterungs-Installation, und /apps/wechat für den WeChat-Assistenten-Eintrag. Beide übersetzt über zh / zh-TW / en / ja / ko.

Empfehlen Sie BibiGPT einem Freund? Werfen Sie ihm einen einzigen aitodo.co/apps-Link zu und lassen Sie ihn den Eintrag wählen, der passt.

🛠️ Reibungsloser zu nutzen

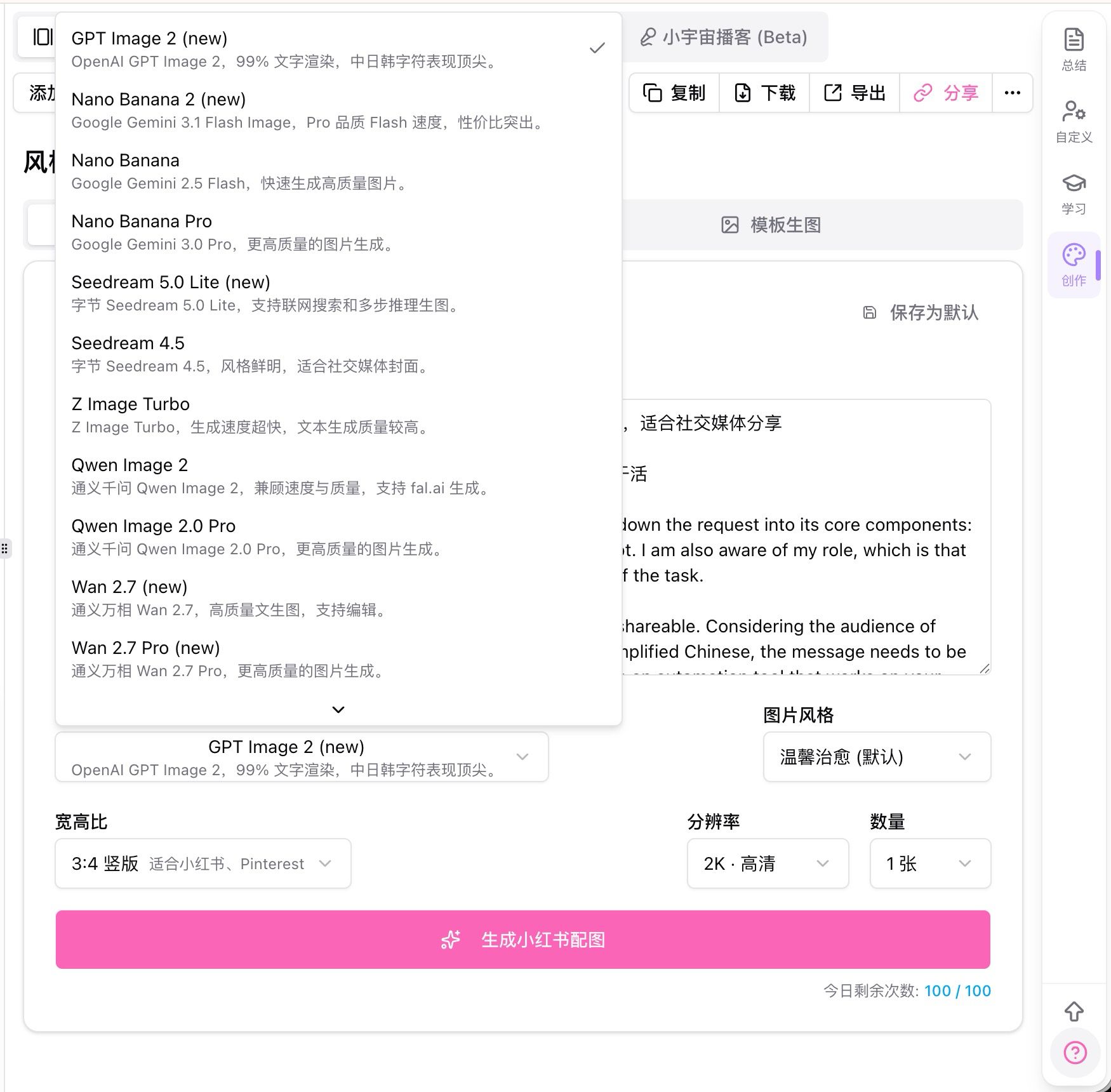

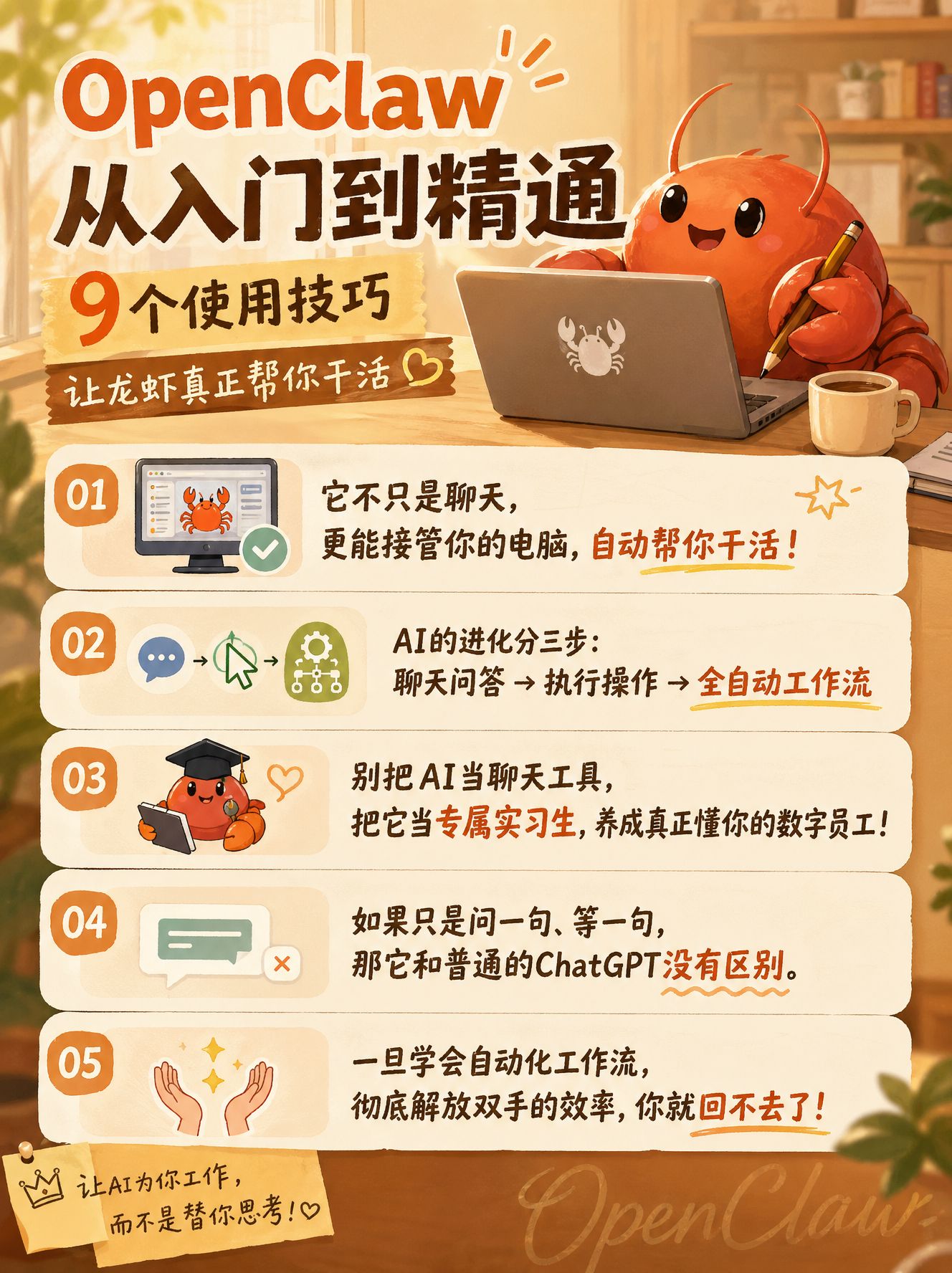

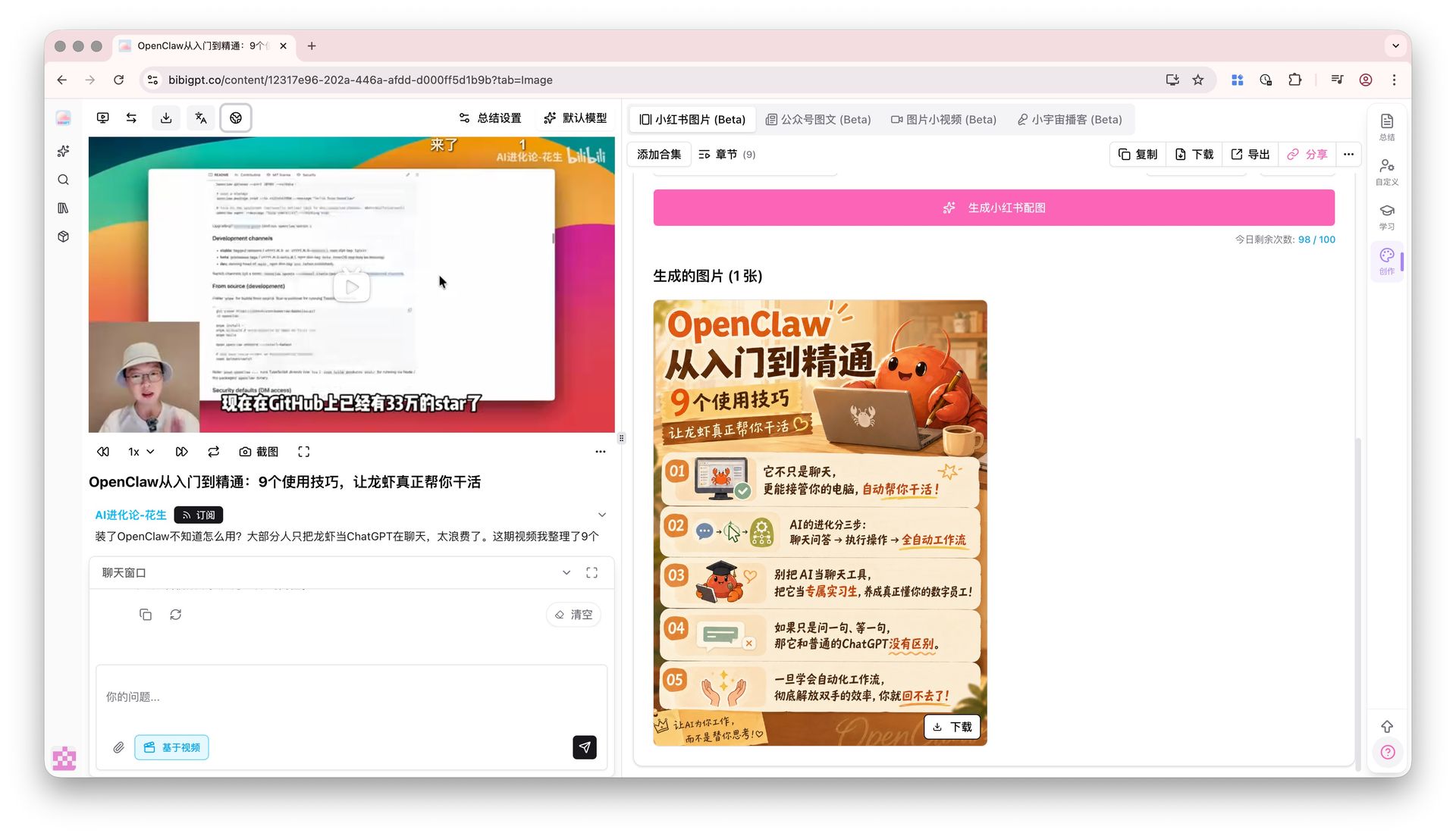

GPT Image 2 landet in BibiGPT-Bildgenerierung

OpenAIs GPT Image 2 ist jetzt in BibiGPTs KI-Bildgenerierung verdrahtet (25 Credits pro Bild). Öffnen Sie KI-Bildgenerierung in BibiGPT und wechseln Sie im Modellauswähler zu GPT Image 2:

Die zwei echten Gewinne:

- Textrendering-Genauigkeit ~99 % — perfekt für Cover, Poster und Social-Media-Kunst, die lesbaren Text direkt im Bild benötigen

- Natives 4K-Output — Standard- / HD-Qualität wählbar

Beispiel-Outputs (Video-Erkenntnisse → veröffentlichungsreifes Poster in ~1 Minute):

Wenn Sie Inhalts-Wiederverwendung machen — eine Twitter- / LinkedIn- / Substack-Pipeline betreiben, Video-Cover entwerfen, Social-Poster vorbereiten — ist das das, was zuerst auszuprobieren ist.

Vision-Analyse-Trio: Auto-Switch + persistenter Chat + Ein-Klick-Cache

Drei Vision-Analyse-Verbesserungen werden diese Woche zusammen ausgeliefert, jede behebt einen spezifischen Ärger:

- Auto-Switch — kurze Videos (unter 5 Minuten) und Videos mit unvollständigen Untertiteln springen jetzt automatisch zum „Vision-Zusammenfassung”-Tab nach Abschluss. Kein Landen mehr auf einem leeren Zusammenfassungs-Bildschirm.

- Persistenter Chat — Vision-Analyse-Folge-Konversationen werden jetzt automatisch wiederhergestellt, wenn Sie die Seite erneut öffnen. Kein Wieder-Fragen, was Sie schon gefragt haben.

- Ein-Klick-Cache (Desktop, nur Online-Videos) — für Bilibili / YouTube und ähnliche Online-Videos klicken Sie „Video jetzt cachen” im Frame-Analyse-Sub-Tab. Das System lädt mit 720p herunter und kettet Keyframe-Extraktion automatisch — kein Wechsel zum Player-Tab nötig, um zuerst zu cachen.

Für Videos mit Vision-Analyse bevorzugt Article Generation jetzt standardmäßig Vision-abgeleitete Zusammenfassungen — finale Artikel-Genauigkeit ist höher, besonders bei Videos, in denen Diagramme oder visueller Inhalt zählen.

Fazit

Das Thema dieser Woche ist „Wettlauf zu den neuesten Modellen, alltägliche Abläufe polieren”. GPT-5.5 / DeepSeek V4 Pro / MiMo V2.5 Tag-Eins-Integration deckt „kann ich das neueste Modell verwenden”; GPT Image 2 + das Vision-Analyse-Trio decken „fühlt es sich im täglichen Gebrauch reibungslos an”. Fügen Sie /apps-Vereinheitlichung obendrauf hinzu, und jedes Bein der „Schneller zu schauen / Leichter zu finden / Reibungsloser zu nutzen”-Schleife wurde wieder gestrafft.

Modelle sind nicht mehr knapp. Die Geschwindigkeit, mit der Sie Inhalt konsumieren, schon. Das ist der echte Subtext unter dem Update dieser Woche.

Probieren Sie BibiGPT aus und starten Sie Ihre KI-gestützte Video-Produktivität:

- 🌐 Website: https://aitodo.co

- 📱 Mobile-Download: https://aitodo.co/apps

- 💻 Desktop-Download: https://aitodo.co/download/desktop

- ✨ Funktionen erkunden: https://aitodo.co/features

Frohes Zusammenfassen!

BibiGPT Team